Deepfake: как использовать, какие риски и как защититься

Deepfake — это технология синтеза реалистичных изображений и видео с помощью ИИ. Она имеет полезные и творческие применения (развлечение, образование, кинопроизводство), но несёт серьёзные риски — дезинформация, мошенничество, кража личности. В статье описаны безопасные сценарии использования, пошаговый пример с приложением Reface, признаки плохих deepfake, рекомендации по защите и оперативный план действий при инциденте.

Что такое deepfake — простая дефиниция

Deepfake — метод создания фальшивых фото и видео, в которых лицо, голос или поведение одного человека заменены на другого с использованием нейронных сетей. Это инструмент: он может служить для творчества или для обмана.

Важное: deepfake — это не отдельная программа, а набор методов (глубокое обучение, генеративные модели, слоистые сопоставления лиц и синтез речи). Понимание этого помогает оценивать, где технология работает хорошо, а где нет.

Уровень сложности современных deepfake

За последние годы качество deepfake существенно выросло. Некоторые ролики выглядят фотореалистично: синхронизация губ, экспрессии и освещение становятся профессиональными. При этом остаются характерные артефакты (неестественные глаза, искажения волос, проблемы с шейным переходом), особенно в динамичных сценах и при сложном освещении.

Пример обсуждаемого случая: онлайн-персонаж, похожий на известного руководителя, вызвал споры о том, реальный это человек или результат цифровой подмены. В таких ситуациях даже массовое восприятие может быть ошибочным — люди склонны верить увиденному, особенно если контент подтверждается другими источниками.

Важно: высокая реалистичность не значит правдивость. Верификация источника и контекста остаются ключевыми.

Безопасные и легальные способы использования deepfake

Ниже перечислены практические, этичные применения технологии:

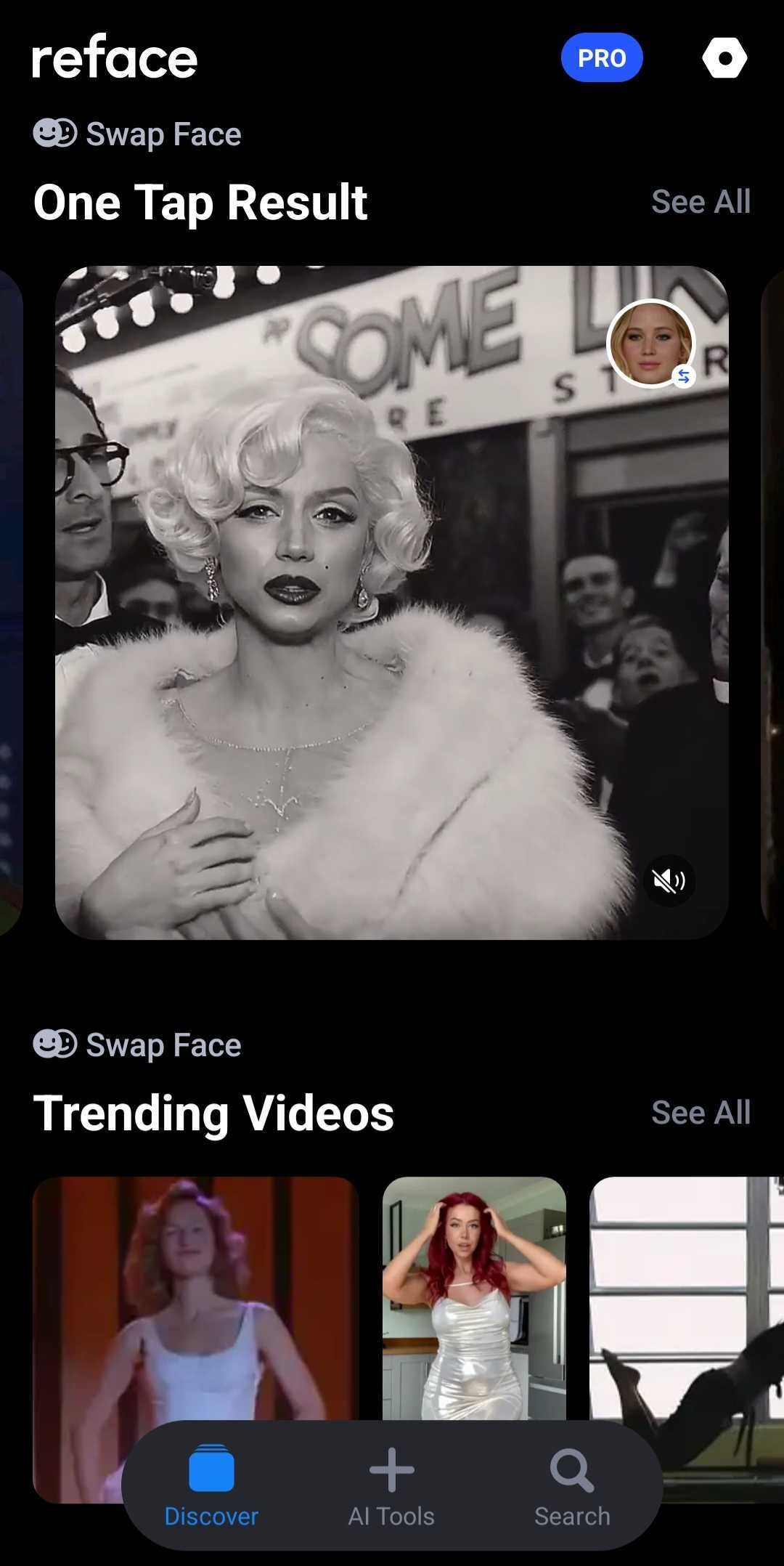

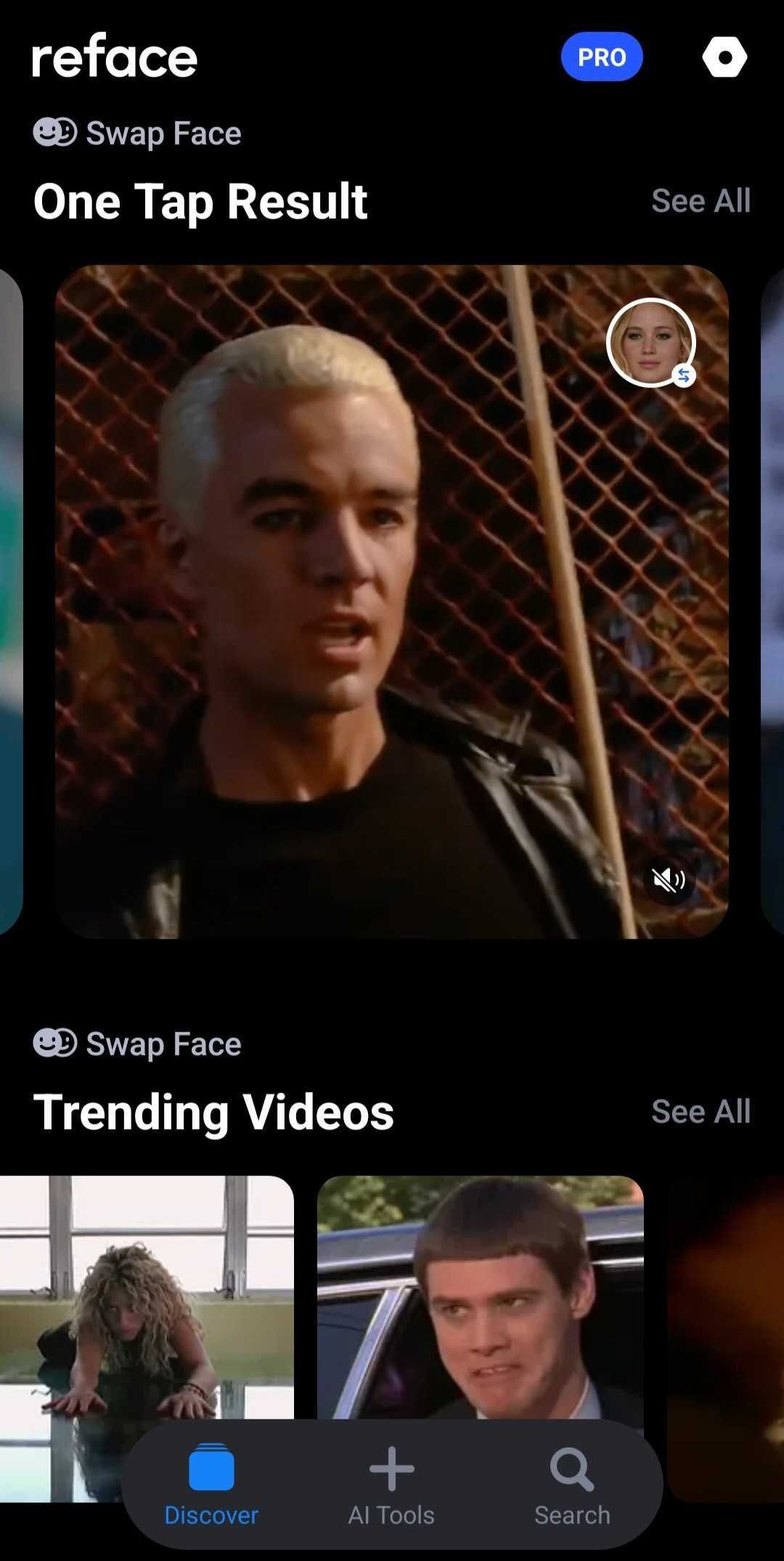

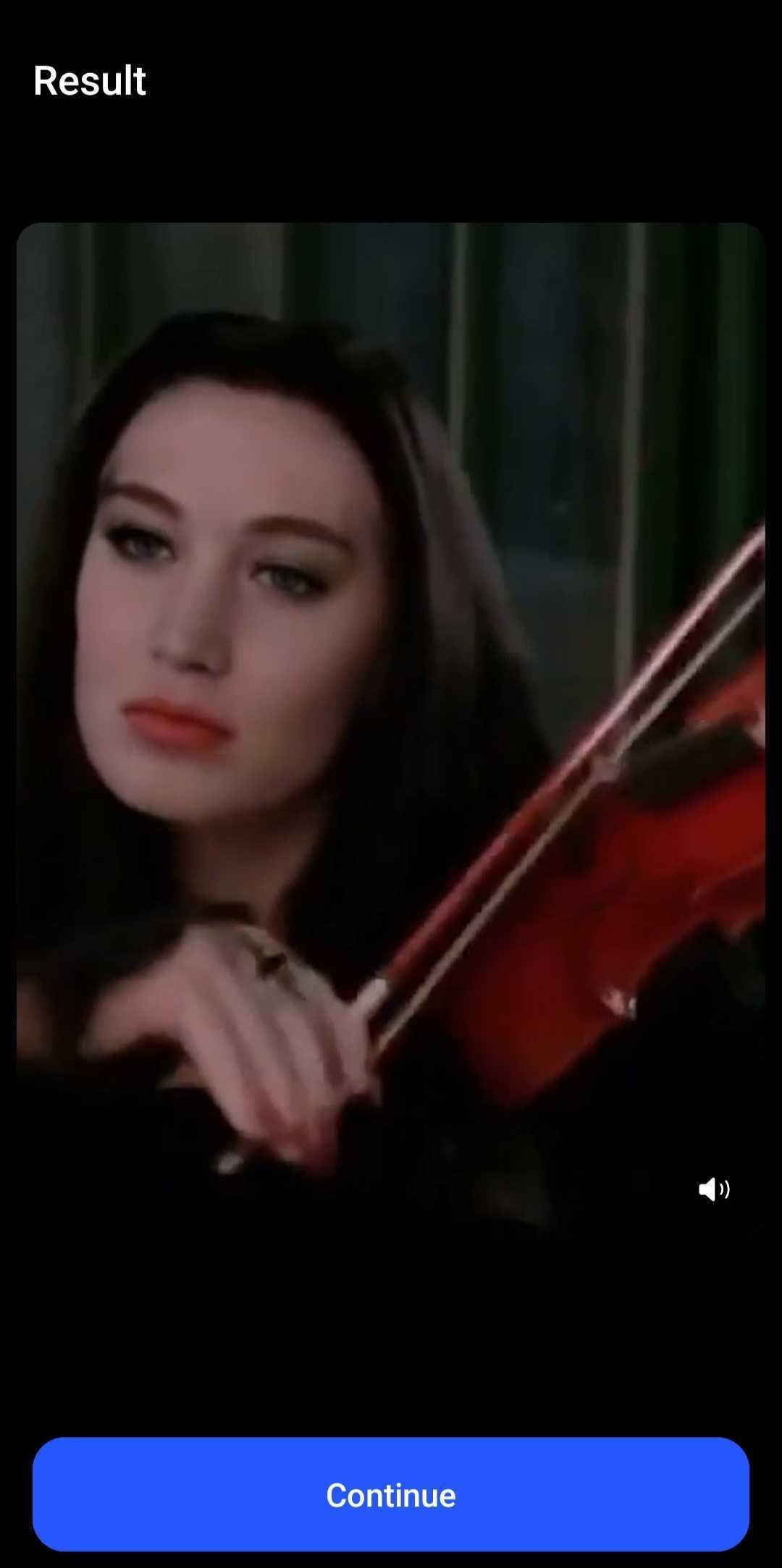

- Развлечение: фильтры и приложения для смены лиц в видеороликах и мемах (например, пример с Reface). Это распространённый и обычно безобидный сценарий для личного использования.

- Образование: интерактивные персонажи (исторические фигуры, учителя-аватары), позволяющие адаптировать подачу материала под аудиторию.

- Кино и телевидение: воссоздание умерших актёров при соблюдении юридических прав или омолаживание персонажей с согласия правообладателей.

- Локализация контента: улучшенная синхронизация губ при дубляже, чтобы зритель не отвлекался на несоответствие речи и мимики.

- Реконструкция архивов: восстановление повреждённых видеозаписей, где требуется чистка и реконструкция лиц.

Примечание: во всех случаях требуется согласие изображаемых лиц и соблюдение авторского права и прав на образ.

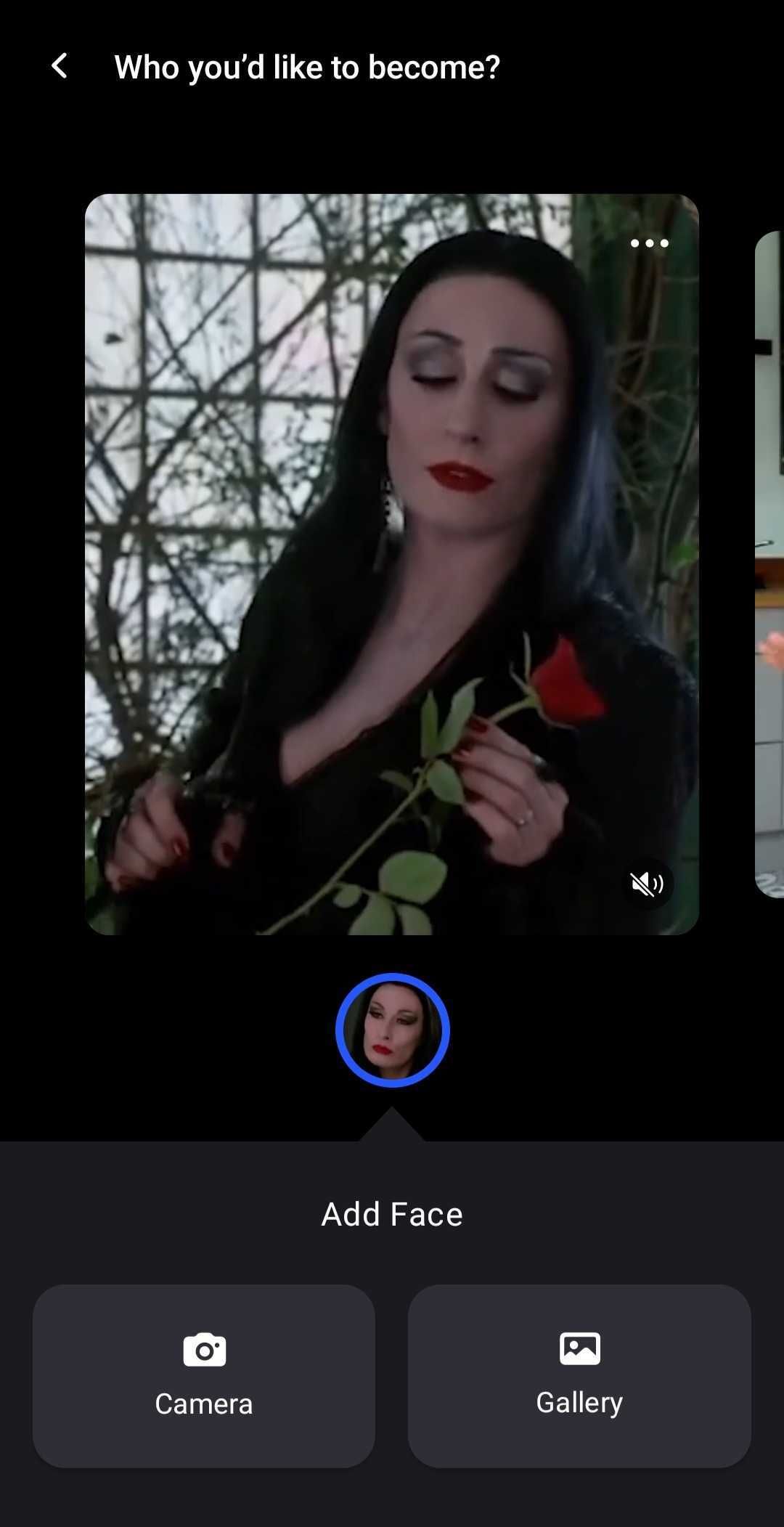

Пошаговое руководство: как попробовать deepfake на смартфоне (пример Reface)

- Установите приложение Reface из Google Play или App Store.

- Выберите шаблонное видео в приложении (например, монтаж с персонажем Morticia из Addams Family).

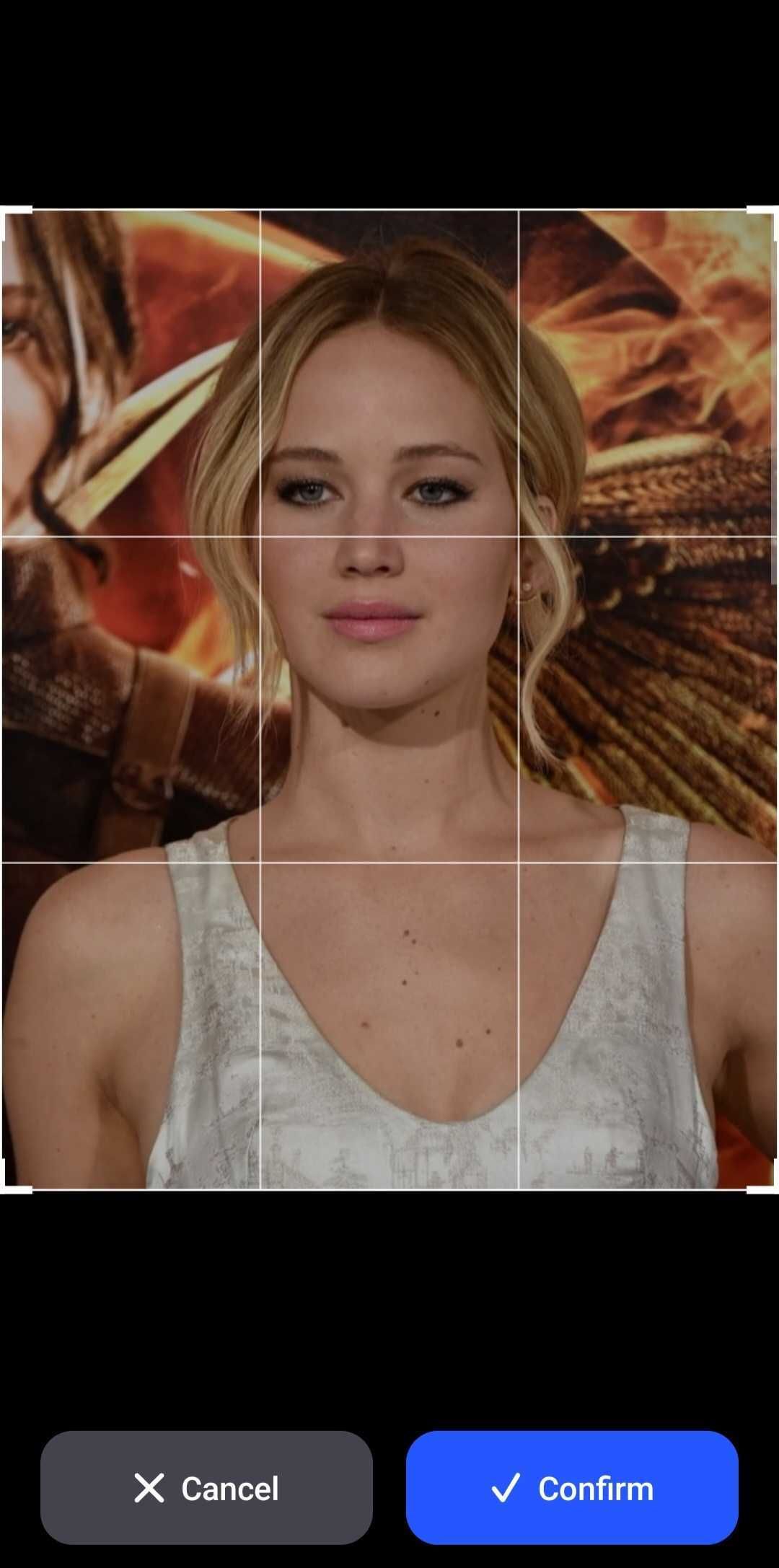

- Выберите лицо для подмены: можно сделать селфи или загрузить фото из галереи.

- Обрежьте изображение по маске, чтобы лицо занимало нужное место в кадре.

- Подтвердите загрузку и дождитесь рендера — за секунды/минуты приложение сгенерирует видео.

Важно: бесплатные и быстрые приложения часто экономят на качестве и приватности данных. Перед загрузкой фото проверьте политику конфиденциальности и разрешения.

Скачать: Reface для Android | iOS (бесплатно, есть премиум-функции)

Тёмная сторона deepfake

Неправомерное применение deepfake охватывает несколько опасных сценариев:

- Дезинформация и политическое вмешательство. Поддельные заявления политиков могут обострять конфликты.

- Мошенничество и финансовые махинации. Подмена голоса и лица используется для вымогательства, открытия счетов и получения выплат.

- Кража личности. Deepfake упрощает создание правдоподобных доказательств для доступа к закрытой информации.

- Воздействие на частную жизнь. Нанесение вреда репутации людей, распространение интимного контента без согласия.

Юридический аспект: в разных странах правила различаются — от явных запретов на распространение интимных deepfake до общих норм по защите персональных данных.

Как распознать плохие deepfake: признаки и тесты

Простой чек-лист для быстрой проверки:

- Неестественные моргания и взгляд. Часто глаза ведут себя непривычно.

- Плохая синхронизация губ при речи.

- Аномалии с волосами и краевым переходом между лицом и шеей.

- Неправильные тени и несоответствие направления света.

- Метаданные файла: иногда указывают на редактирование.

- Контекст и источник: случайные аккаунты, недавно созданные профильные страницы, отсутствие подтверждающих источников.

Тесты:

- Обратный поиск изображения в Google/Яндекс.

- Сравнение подозрительного ролика с авторитетными источниками и новостями.

- Запрос оригинала у предполагаемого автора.

Ограничения: продвинутые deepfake могут преодолевать часть этих проверок, поэтому лучше использовать мультиподход — визуальные, технические и фактчекинг.

Когда deepfake не сработает или покажет признаки ошибки

- Сцены с сильными движениями головы и быстрым поворотом. Алгоритмы часто теряют трассировку деталей.

- Сложное освещение: сильные контровые или микрорефлексы на коже.

- Очень низкое разрешение исходного материала.

- Несоответствие голосовой интонации и тембра, если синтезируется также аудио.

Пример: попытка подменить лицо в нелинейном разговоре с множеством участников обычно даёт артефакты и «плавающие» зоны вокруг рта.

Альтернативы deepfake для этичных задач

- Традиционная компьютерная графика и VFX: контроль качества и юридическая прозрачность.

- Костюмированные актёры и дублёры: сохраняют авторскую верификацию.

- Озвучивание и дубляж профессиональными голосовыми актёрами при локализации.

- Аватары на основе синтезированного голоса с явным пометкой «создано ИИ».

Эти методы подходят, если требуется прозрачность, сохранение прав и минимизация юридических рисков.

Руководство для ролей: чек-листы

Чек-лист для создателей контента:

- Получили явное письменное согласие изображаемого лица.

- Указали в описании, что контент искусственно создан.

- Проверили политику платформы на предмет deepfake.

- Сохранили оригиналы и логи генерации для верификации.

Чек-лист для преподавателя/музея:

- Получили согласие от правообладателя образа.

- Включили образовательную справку о том, что персонаж реконструирован.

- Убедились в отсутствии вводящих в заблуждение утверждений.

Чек-лист для специалистов по безопасности/ЖУРНАЛИСТОВ:

- Выполнили мульти-проверку источников.

- Использовали инструменты детекции и экспертный анализ.

- Подготовили план реагирования на распространение ложной информации.

Минимальная методология проверки видео (быстрая процедура)

- Сбор метаданных и анализ контейнера файла.

- Визуальный осмотр на артефакты (глаза, губы, тени).

- Обратный поиск кадров и изображений.

- Перекрёстная проверка фактов, упомянутых в видео, в независимых источниках.

- При серьёзных последствиях — привлечение судебно-медийных экспертов.

План реагирования на инцидент с deepfake

- Классификация инцидента: репутационный, финансовый, политический.

- Сбор доказательств и сохранение оригинальных файлов.

- Оповещение пострадавших лиц и юристов.

- Контакт с платформами (сообщить о нарушении) и запрос на удаление.

- Публичная коммуникация: честное заявление с фактами и опровержениями.

- Мониторинг распространения и правовые действия при необходимости.

Критерии приёмки: контент признан неаутентичным при наличии как минимум двух независимых признаков подделки и отсутствия подтверждающих источников.

Риски и меры смягчения

Риски:

- Финансовые убытки вследствие мошенничества.

- Ущерб репутации физических лиц и организаций.

- Социальная дестабилизация через массовую дезинформацию.

Меры смягчения:

- Политики платформ по маркировке ИИ-контента.

- Технологии цифровой подписи контента и ВОД (watermarking).

- Обучение пользователей распознаванию фальшивок.

- Юридические инструменты: уголовное преследование при мошенничестве и защита персональных данных.

Безопасность и приватность при работе с deepfake

Советы по безопасности:

- Не загружайте личные или чужие фотографии на ненадёжные сайты.

- Читайте и понимайте политику хранения данных приложения.

- Используйте двухфакторную аутентификацию на сервисах, где хранится чувствительный контент.

Примечание о GDPR и защите данных:

- Личные изображения и биометрические данные подпадают под регулирование во многих юрисдикциях.

- Для обработки изображений третьих лиц обычно требуется явное согласие или законное основание.

- Хранение и передача биометрических данных должны быть минимизированы и защищены.

Технические рекомендации по защите контента

- Внедрять цифровые подписи и метки происхождения (provenance). Это позволяет отслеживать, где и когда был создан файл.

- Добавлять невидимые водяные знаки в оригинальные видеоданные.

- Использовать инструменты обнаружения deepfake, которые анализируют модели шума, спектр частот и временные несоответствия.

Ограничения технологий обнаружения: алгоритмы детекции тоже развиваются, и против них появляются методы обхода. Поэтому технические меры следует сочетать с организационными.

Когда deepfake допустим и когда недопустим

Допустимы случаи:

- Добровольное развлечение с собственными изображениями.

- Образовательные или художественные проекты с явной маркировкой.

- Коммерческие проекты с получением прав и согласий.

Недопустимы случаи:

- Создание материалов с целью обмана, клеветы или финансовой выгоды.

- Использование образов без согласия для интимного контента.

- Попытки подделать юридические доказательства или идентификационные данные.

Тестовые сценарии и критерии приёмки систем детекции

Критерии тестирования:

- Чувствительность: насколько хорошо система ловит реальные deepfake.

- Специфичность: насколько часто система даёт ложные срабатывания на реальные видео.

- Устойчивость к постобработке: сохраняется ли обнаружение после сжатия и изменения освещения.

Примеры тестов:

- Набор из 1000 реальных и 1000 синтезированных видео, с разными битрейтами и форматами.

- Оценка по метрикам ROC AUC, precision/recall.

(Замечание: здесь описаны методики, а не конкретные числа, чтобы не вводить в заблуждение.)

Краткое резюме

Возможности deepfake широки: от весёлых фильтров до инструментов, меняющих индустрию развлечений и образования. Однако технология несёт значимые риски, связанные с мошенничеством, дезинформацией и нарушением приватности. Комбинация технических мер (водяные знаки, цифровые подписи, детекторы), организационных правил (согласие, прозрачность) и юридических механизмов — оптимальный путь для минимизации вреда.

Важно: будьте внимательны к источникам, помечайте ИИ-контент и защищайте свои персональные данные.

Summary

- Используйте deepfake ответственно и получайте согласие изображаемых.

- При проверке сомнительного видео применяйте несколько методов: визуальный осмотр, метаданные, фактчекинг.

- Для организаций — внедряйте политики маркировки и технологии provenance.

Important: Если вы столкнулись с мошенничеством, сохраните оригиналы, свяжитесь с платформой и проконсультируйтесь с юристом.