Как установить и использовать Stable Diffusion локально с графическим интерфейсом

Важно: при работе с LLM/генеративными моделями соблюдайте законы и этические ограничения в вашей юрисдикции, не используйте модель для создания запрещённого контента и уважайте авторские права.

Быстрые ссылки

- Что такое Stable Diffusion?

- Что нужно для запуска этой версии Stable Diffusion?

- Как установить Stable Diffusion с графическим интерфейсом

- Как генерировать изображения с помощью WebUI от AUTOMATIC1111

- Как замаскировать созданные изображения для инпейнта

- Как использовать Stable Diffusion с ComfyUI

- Как исправить ошибку “CUDA Out Of Memory” в WebUI AUTOMATIC1111

Что такое Stable Diffusion?

Stable Diffusion — это генеративная модель для создания или модификации изображений на основе текстовых подсказок (prompt). Она позволяет сгенерировать изображение «с нуля» по описанию или изменить часть существующего изображения, используя техники, называемые img2img и inpainting. Модель была публично доступна и широко использовалась со второго полугодия 2022 года и далее. Ключевые отличия Stable Diffusion:

- Возможность запуска локально на ПК — вы храните модель и входные данные у себя.

- Модель и многие форки доступны в открытом доступе: сообщество создало удобные графические интерфейсы и плагины.

Краткое определение: Stable Diffusion — текст‑в‑изображение генератор, оптимизированный для локального запуска и расширяемый через модели и плагины.

Важно: открытость проекта привела к множеству пользовательских интерфейсов (fork). В этой инструкции мы рассматриваем два популярных варианта с GUI: AUTOMATIC1111 WebUI (интуитивный, простой для новичка) и ComfyUI (узловой/ node-based, мощный для продвинутых цепочек обработки).

Что нужно для запуска этой версии Stable Diffusion?

Минимальный и рекомендованный набор компонентов и требований с пояснениями.

- Свободное место на диске: минимум 10 ГБ (для базовой установки). Checkpoint-файлы и дополнительные модели могут занимать десятки гигабайт — имейте запас.

- Операционная система: Windows 10 / 8.1 / 8 / 11 (в статье описана установка на Windows). Многие шаги схожи для Linux, но команды и скрипты отличаются.

- Python: рекомендуемая версия — 3.10.6 (используйте именно её для совместимости с большинством сборок WebUI).

- Git: нужен для удобного скачивания репозитория или его обновления.

- NVIDIA GPU с минимум ~6 ГБ VRAM (на практике 6 ГБ — «нижняя граница»; 8–12 ГБ — комфортно; 12+ ГБ — для больших разрешений и SDXL). На GPU с 4 ГБ возможно запустить с сильным урезанием настроек и оптимизациями, но стабильность и возможности будут ограничены.

- AMD GPU: существуют способы запустить, но потребуется ручная настройка и патчи (менее удобно для новичка).

- Checkpoints (веса моделей): Stable Diffusion 1.5, SDXL и др. Многие GUI автоматизируют загрузку 1.5, но для SDXL часто требуется ручная загрузка.

- Дополнительные модели/модули: GFPGAN/RealESRGAN/ESRGAN/CodeFormer для улучшения лиц и апскейла; LORA/embeddings для специализированных стилей; refiner для SDXL и т.д.

Примечание: некоторые форки и GUI предоставляют инсталляторы или скрипты, которые автоматически настроят окружение и загрузят зависимости.

Как установить Stable Diffusion с графическим интерфейсом

Ниже — подробный пошаговый процесс для Windows, охватывающий оба GUI: AUTOMATIC1111 WebUI и ComfyUI. Большая часть шагов взаимозаменяема.

1) Установка Python

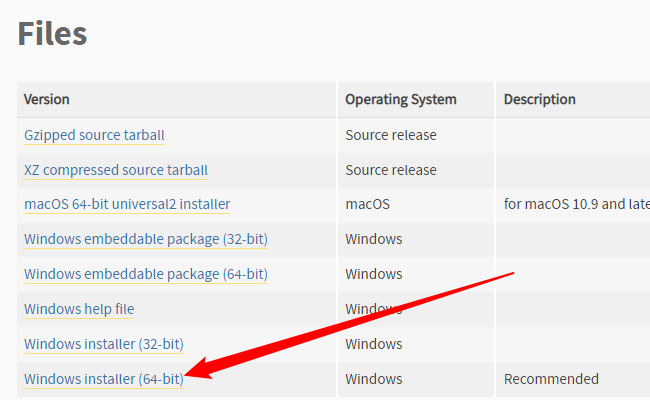

- Зайдите на официальный сайт Python и скачайте версию 3.10.6. Выберите “Windows Installer (64‑Bit)”.

- Запустите скачанный установщик и выберите “Install” или “Upgrade”, если версия Python уже установлена.

- Обязательно отметьте опцию “Add Python 3.10 to PATH” для удобства запуска из командной строки.

Совет: если вы планируете экспериментировать с несколькими версиями Python, используйте виртуальные окружения (venv) или управляйте версиями через pyenv (Linux/macOS) — но для базовой работы это не обязательно.

2) Установка Git и загрузка репозитория

- Скачайте Git для Windows (64‑bit) и установите, оставив рекомендованные параметры, если не уверены.

- Перейдите на GitHub-страницу выбранного GUI:

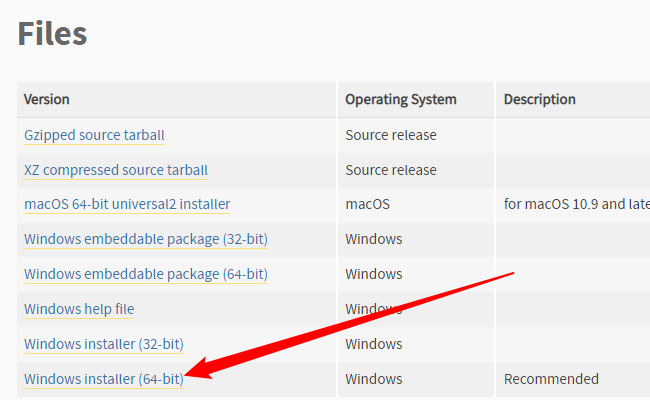

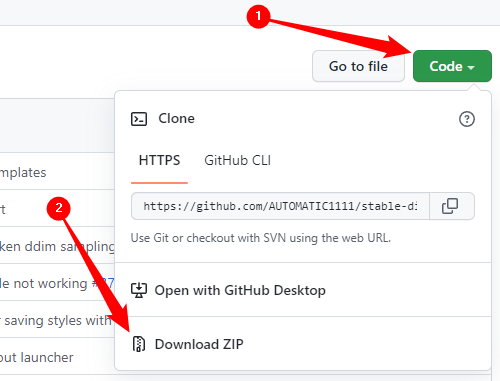

- AUTOMATIC1111 WebUI: нажмите зелёную кнопку “Code” → “Download ZIP” или клонируйте репозиторий.

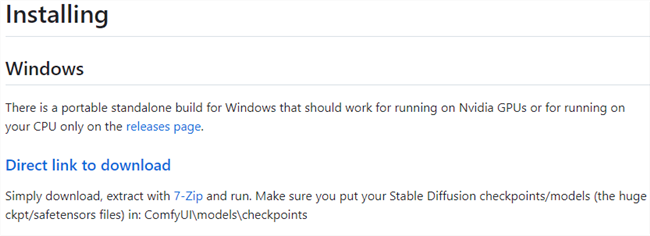

- ComfyUI: перейдите в раздел “Installing” и используйте “Direct Link to Download” или клонирование.

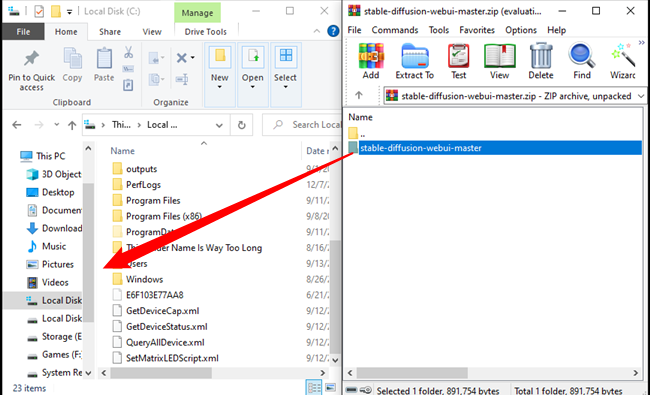

- Распакуйте архив в удобную папку — это будет рабочая директория. Пример: распаковка в C:.

Важно: не помещайте папку внутрь другой папки по ошибке — проверяйте путь.

3) Загрузка чекпоинтов (weights)

Checkpoints — файлы с обученными весами модели. Без них генерация невозможна.

- AUTOMATIC1111 WebUI часто автоматически скачивает Stable Diffusion 1.5 при первом запуске; SDXL и другие варианты скачиваются вручную.

- ComfyUI обычно не скачивает чекпоинты автоматически — их нужно загрузить вручную.

Память и объём: файлы весят несколько гигабайт, загрузка может занять время.

Размещение:

- Для AUTOMATIC1111: поместите файлы в C:\stable-diffusion-webui\models\Stable-diffusion

- Для ComfyUI: C:\ComfyUI_windows_portable\ComfyUI\models\checkpoints

Дополнительно вы можете добавить папки для upscalers, LORA и других моделей — GUI создаёт для них соответствующую структуру. Просто перетащите файлы в нужные папки.

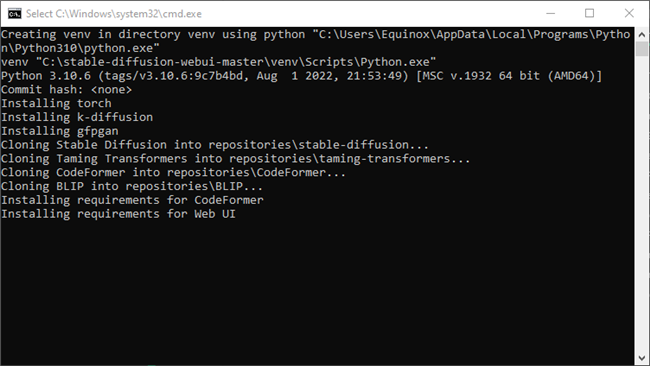

4) Первый запуск (batch-файл)

- Для AUTOMATIC1111: дважды кликните webui-user.bat

- Для ComfyUI (NVIDIA): дважды кликните run_nvidia_gpu.bat

Первый запуск может занять несколько минут — система скачает зависимости и установит дополнительные пакеты.

В конце консоль должна показать примерно такое сообщение:

Running on local URL: http://127.0.0.1:7860 To create a public link, set `share=True` in `launch()`ComfyUI по умолчанию использует порт 8188 (http://127.0.0.1:8188).

Как генерировать изображения в AUTOMATIC1111 WebUI

Откройте браузер и введите адрес: http://127.0.0.1:7860 или http://localhost:7860. По умолчанию вы попадёте на вкладку txt2img — генерация изображения по текстовой подсказке.

Описание основных полей и подсказки по значениям:

- Prompt: текстовое описание того, что хотите получить. Чем конкретнее, тем предсказуемее результат.

- Painter’s Palette: применяет случайный художественный стиль к промпту.

- Sampling Steps: число шагов семплирования. 20–50 шагов — обычный диапазон; больше шагов обычно повышает детализацию, но даёт убывающую отдачу.

- Sampling Method: алгоритм семплирования (например, Euler a, PLMS). Разные семплеры даёт разные варианты изображений.

- Restore Faces: включает GFPGAN/CodeFormer для улучшения лиц.

- Batch Count: число отдельных прогонов генерации (сколько партий изображений в целом).

- Batch Size: количество изображений за один прогон (обычно 1, увеличивать только при большом VRAM).

- CFG Scale (classifier-free guidance): управляет тем, насколько строго модель следует промпту. Диапазон ~3–12: низкие — творческие отклонения, высокие — строгое соответствие.

- Width / Height: размер выходного изображения (например, 512×512). Чем выше — тем больше VRAM.

- Seed: число, задающее начальную случайность. -1 означает случайный seed; фиксированный seed даёт повторимый результат.

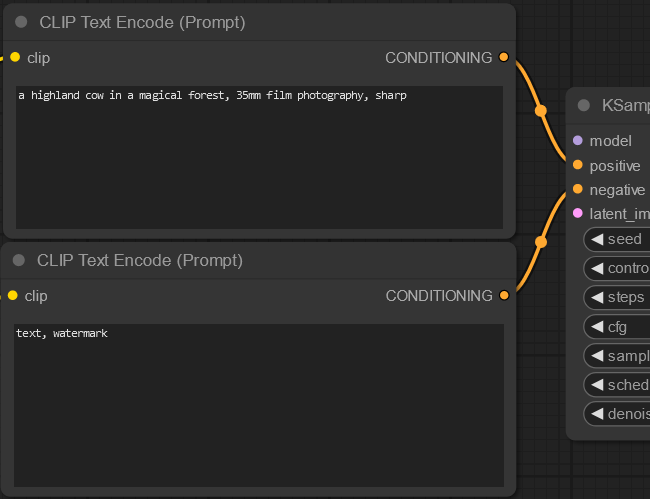

Пример генерации: промпт “a highland cow in a magical forest, 35mm film photography, sharp” с sampler Euler a, steps 40, CFG 5. По завершении вы получите несколько вариаций. Нажмите “Interrupt”, если нужно прервать генерацию.

Выберите понравившийся результат и используйте “Send to Inpaint” для доработки.

Маскирование и инпейтинг (Inpainting)

Инпейтинг позволяет частично изменить изображение, сохранив остальную его часть. WebUI предлагает два режима:

- Inpaint masked — модель изменит область, отмеченную маской.

- Inpaint not masked — изменится всё, кроме отмеченной области (область будет сохранена).

Пошагово (Inpaint masked):

- Нажмите и ведите левой кнопкой мыши по области, которая должна измениться. При рисовании появится белая маска.

- Закрасьте полностью область — не просто обведите. Маска должна покрывать нужный фрагмент.

- Для создания нового объекта в сцене используйте «Masked Content: Latent Noise» (даёт лучшие результаты при генерации новых элементов).

- Настройки по умолчанию: Mask Blur 10, Inpaint Area: Whole Picture, Sampling Method: Euler A, Sampling Steps: 30, CFG Scale: 5 — хорошие стартовые точки.

Примеры промптов для inpaint:

- “a highland cow wearing a chef’s hat in a magical forest, 35mm film photography, sharp”

- “a highland cow wearing a bowler hat in a magical forest, 35mm film photography, sharp”

Результаты зависят от точности маски, выбранного семплера и настроек шума. Для создания одного точного объекта в сцене генерируйте несколько вариантов (Batch Size > 1) и выберите лучший.

Если нужно сохранить центральный объект и заменить фон — используйте Inpaint not masked: закрасьте все, что должно сохраниться, и модель изменит остальное.

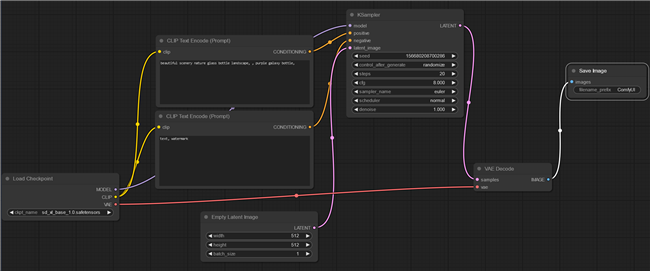

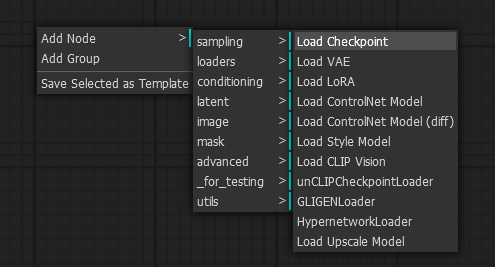

Как использовать ComfyUI: узловой (node-based) подход

ComfyUI — альтернатива WebUI, ориентированная на гибкость. Здесь вы создаёте «поток» обработки изображения, соединяя узлы (nodes). Каждый узел выполняет отдельную задачу: загрузку модели, кодирование текста, создание латентной картины, сам семплер и декодер.

Основные узлы и их назначение:

- Load Checkpoint — загрузка весов модели.

- Clip Text Encode — кодирование положительного и отрицательного промптов.

- Empty Latent Image — создание зашумлённого (латентного) изображения.

- KSampler — узел с семплером (он преобразует шум в изображение).

- VAE Decode — декодирование латентного представления в итоговое изображение.

- Save Image — запись результата на диск.

В ComfyUI вы вручную соединяете входы и выходы узлов, как конвейеры на фабрике. Пример: промпт вводится в Clip Text Encode → подключается к KSampler в позицию positive → KSampler соединён с VAE Decode → Save Image.

Важные параметры в ComfyUI:

- Seed — начальная случайность. Фиксация seed даёт повторяемость.

- CFG — как строго модель следует промпту.

- Steps — количество шагов семплирования.

- Sampler_name — выбор алгоритма семплирования.

- Denoise — важен при img2img/inpainting: чем выше — тем сильнее отклонение от исходного изображения.

Размер изображения задаётся в узле Empty Latent Image: начните с 512×512 для экономии VRAM; при 12 ГБ VRAM можно попробовать 1024×1024.

ComfyUI сильна тем, что вы можете добавлять промежуточные узлы (upscalers, refiner, face restoration) и строить сложные пайплайны. Сообщество создало множество готовых workflows.

Практические рекомендации: промпты, CFG и семплеры

- Промпты: короткие описания дают широкий разброс; длинные, структурированные промпты (с перечислением стиля, техники, освещения, камеры, деталей) повышают предсказуемость.

- Негативные промпты: список того, чего вы не хотите видеть (например, “bad hands, low quality, watermark”) — помогает фильтровать нежелательные артефакты.

- CFG: 4–7 для больше художественности; 7–12 для точного соответствия. Экспериментируйте.

- Seed: фиксируйте seed для воспроизводимости. С тем же seed и теми же параметрами вы получите схожий результат.

- Семплеры: Euler a — популярный выбор; PLMS и другие иногда дают более мягкие или более резкие результаты. Тестируйте.

- Upscaling: сначала сгенерируйте при комфортном разрешении, затем примените RealESRGAN/ESRGAN для повышения разрешения и качества деталей.

Шаблон промпта для фотографии:

“[предмет], [окружение], [стиль (фото/иллюстрация)], [тип объектива или камера, например 35mm], [освещение], [настроение], sharp, high detail”.

Пример: “a highland cow in a magical forest, 35mm film photography, soft golden backlight, cinematic, sharp, high detail”

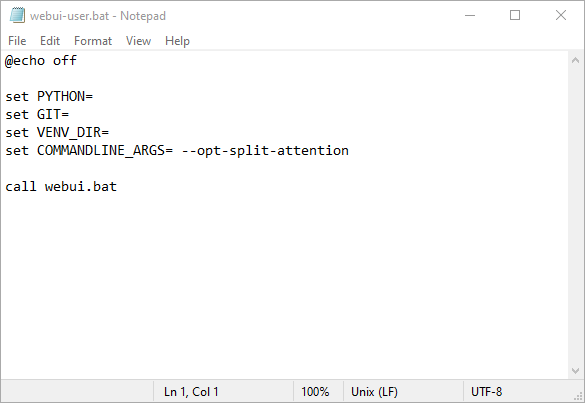

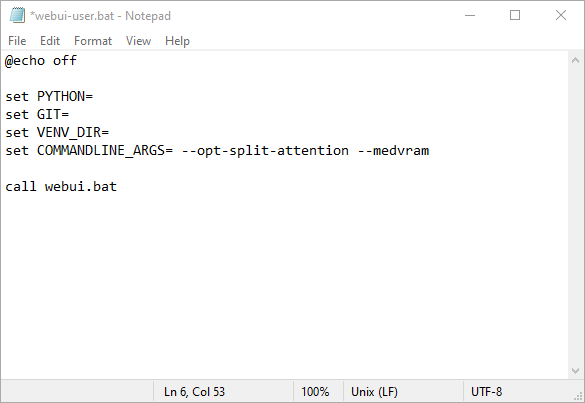

Оптимизация VRAM и устранение ошибки “CUDA Out Of Memory”

Если при запуске или генерации появляется сообщение об ошибке “CUDA out of memory” — это означает недостаток видеопамяти. Вот подробный план действий и параметры, которые можно добавить в webui-user.bat:

- Откройте webui-user.bat в Блокноте (Notepad) или другом текстовом редакторе. Найдите строку:

set COMMANDLINE_ARGS=- Попробуйте добавить и сохранить следующие аргументы (можно по очереди):

- –opt-split-attention — оптимизирует использование памяти при некоторых GPU.

- –medvram — уменьшает использование в средних объёмах VRAM.

- –lowvram — сильнее снижает использование VRAM, но может быть медленнее и не всегда совместимо с некоторыми функциями.

- –always-batch-cond-uncond — необходим при некоторых конфигурациях для экономии памяти.

- Другие советы по уменьшению потребления памяти:

- Уменьшите разрешение изображения (Width/Height). Попробуйте 256×256 или 384×384 для тестов.

- Уменьшите Batch Size до 1.

- Снизьте количество Sampling Steps и оцените качество.

- Отключите Restore Faces или другие дополнительные операции.

- Установите xformers (если поддерживается сборкой) — это может снизить использование памяти и ускорить работу.

- Если всё ещё OOM — рассматривайте апгрейд GPU или использование удалённого облачного сервера с большим VRAM.

SOP: быстрый рабочий процесс (Playbook) для создания финального изображения

Шаги для получения качественной финальной картинки с локальной установкой:

- Подготовка:

- Убедитесь, что установлены нужные checkpoints и модели для апскейла/ретуши.

- Откройте WebUI или ComfyUI.

- Быстрый прототип:

- Сгенерируйте 4–8 вариантов с низким разрешением (например, 512×512, CFG 5–7, 20–30 шагов).

- Выберите 2–3 лучших.

- Детализация:

- На выбранной версии используйте img2img с небольшим denoise для сохранения композиции, но улучшения деталей.

- Либо сделайте inpaint на областях, требующих изменения.

- Апскейл и ретушь лица:

- Примените RealESRGAN или GFPGAN для улучшения лиц и увеличения разрешения.

- Финальная проверка:

- Просмотрите на предмет дефектов (пальцы, текст, странные артефакты) и при необходимости скорректируйте.

- Версионирование:

- Сохраните итоговые параметры (prompts, seed, sampler, steps), чтобы повторить результат.

Чек‑лист при установке и первом запуске

- Скачан и установлен Python 3.10.6 с добавлением в PATH

- Установлен Git

- Загружен репозиторий WebUI и/или ComfyUI

- Помещены чекпоинты в правильные папки

- Запущен webui-user.bat или run_nvidia_gpu.bat

- [ ] В браузере открывается http://127.0.0.1:7860 (или 8188 для ComfyUI)

- Сгенерирован тестовый набор изображений

Роли и их приоритеты при проверке:

- Художник: проверяет композицию, стиль и выразительность.

- Техник: проверяет стабильность установки, доступность GPU и логи.

- Контент‑менеджер: проверяет соответствие правовым и этическим требованиям.

Роль‑базированные чек‑листы

Художник (начальный):

- Понять, как формулировать промпт.

- Сгенерировать 10 вариантов с разными CFG и семплерами.

- Выбрать и довести 2 варианта до финала.

Опытный пользователь / исследователь:

- Настроить ComfyUI workflow для многомодельной обработки.

- Подключить LORA модели и embeddings.

- Сравнить результаты разных чекпоинтов.

Системный администратор:

- Обеспечить резервное копирование чекпоинтов.

- Настроить swap/caching и мониторинг GPU.

- Прописать инструкции отката (rollback) при ошибках обновления.

Incident runbook: что делать при критических ошибках

Сценарий: WebUI не запускается / консоль падает / GPU перегревается / OOM.

- WebUI не запускается:

- Откройте консольный вывод и найдите первые ошибки (отсутствие зависимостей, ошибки в Python‑пакетах).

- Выполните ‘git pull’ в папке webui и пересоздайте окружение — иногда обновления ломают зависимости.

- Убедитесь, что Python добавлен в PATH и что используется требуемая версия (3.10.6).

- Ошибка OOM при генерации:

- Уменьшите разрешение и batch size.

- Примените аргументы в webui-user.bat: –opt-split-attention, –medvram, –lowvram.

- GPU перегрелся / компьютер зависает:

- Остановите процесс, дайте системе остыть, проверьте охлаждение (вентиляторы, пыль).

- Уменьшите нагрузку: меньшие размеры, меньше шагов.

- Коррупция чекпоинта (файл не читается):

- Проверьте контрольную сумму файла (если доступна) и перекачайте файл заново.

- Модель выдаёт нежелательный результат (нарушение правил):

- Удалите контент; не публикуйте; пересмотрите промпты и фильтры.

Тестовые сценарии и критерии приёмки

Критерии приёмки установки:

- Веб‑интерфейс открывается по адресу 127.0.0.1:7860 (или 8188)

- Минимум одна модель успешно загружена и видна в интерфейсе

- Успешная генерация как минимум 1 изображения размером 512×512 без OOM

Тестовые кейсы генерации:

- Генерация при seed фиксированном и при -1 — сравнить воспроизводимость

- Инпейтинг области — область должна измениться согласно промпту, остальное изображение — оставаться

- Апскейл — структура изображения не должна потерять композицию

Подходы и альтернативы

- Локальный запуск (WebUI/ComfyUI): контроль приватности, нулевая зависимость от интернета, но требуется локальный GPU.

- Облачные сервисы (RunPod, Lambda, Gradio Hosted): не требуют локального GPU, платные и внешние, удобны для тестов и масштабирования.

- GPU удалённого сервера: компромисс — вы получаете большой VRAM без апгрейда локального ПК.

Когда локальный запуск не подходит: если у вас слабый ПК (нет совместимой GPU) или необходима масштабируемая обработка больших партий изображений, лучше рассмотреть облачные решения.

Безопасность, приватность и юридические заметки

- Локальная установка обеспечивает высокий уровень приватности: промпты и сгенерированные изображения хранятся у вас.

- Однако многие модели обучались на данных с неизвестными лицензиями; будьте осторожны с коммерческим использованием изображений, сгенерированных на базе общедоступных весов.

- GDPR / защита персональных данных: если вы обрабатываете персональные данные (фото людей), убедитесь, что у вас есть законные основания на обработку и хранение таких данных.

- Не используйте модель для создания контента, нарушающего закон (экстремистский, незаконный, нарушение товарных знаков и т.п.).

Шаблоны / Cheat Sheet: полезные промпты и настройки

Базовый фото‑промпт: “a [предмет], [локация], [камерная терминология: 35mm/85mm], [освещение], cinematic, photorealistic, sharp, high detail”

Промпт для иллюстрации/арт‑стиля: “[предмет], painted in the style of [стиль], dramatic lighting, high detail, intricate textures”

Негативный промпт (стандарт): “lowres, bad anatomy, bad hands, watermark, text, jpeg artifacts”

Рекомендуемые стартовые параметры:

- Width/Height: 512×512

- Steps: 20–40

- Sampler: Euler a

- CFG: 4–8

- Batch Size: 1

Ментальные модели и эвристики для улучшения результатов

- «Разделяй и владей»: сначала получи хорошую композицию на низком разрешении, затем переходи к деталям.

- «Снижение шума»: если итог слишком далёк от промпта, уменьшай denoise в img2img, увеличивай CFG в txt2img.

- «Фиксируй переменные»: для экспериментов фиксируй seed и постепенно меняй один параметр, чтобы понимать его влияние.

Краткий глоссарий (одно‑строчные определения)

- Checkpoint: файл с весами модели (веса нейросети).

- Prompt: текстовое описание, по которому модель генерирует изображение.

- Seed: начальное число для генерации псевдослучайной последовательности, определяет вариативность результата.

- CFG Scale: сила следования промпту (classifier‑free guidance).

- Inpainting: частичная генерация изображения в отмеченной области.

- Upscaler: модель для увеличения разрешения и улучшения деталей.

Сводка и рекомендуемая дорожная карта (roadmap)

- Начните с WebUI (AUTOMATIC1111) — быстрое знакомство и базовые возможности.

- Освойте основные параметры: prompt, CFG, sampler, steps.

- Попробуйте inpainting и upscaling (GFPGAN, RealESRGAN).

- Перейдите к ComfyUI для сложных пайплайнов и автоматизации обработки.

- По мере роста требований — рассмотрите удалённые GPU/облачные сервисы или апгрейд локального железа.

Краткое резюме: локальная установка Stable Diffusion с GUI даёт гибкость, приватность и контроль над генерацией изображений. Для большинства пользователей достаточно Python 3.10.6, Git, NVIDIA GPU с 6–12 ГБ VRAM и базовых моделей. WebUI подходит для быстрого старта, ComfyUI — для продвинутых сценариев. В статье приведены практические шаги, советы по оптимизации VRAM, чек‑листы и план действий при ошибках.

Ключевые рекомендации: делайте резервные копии чекпоинтов, фиксируйте параметры генерации для воспроизводимости и экспериментируйте по одному параметру за раз.

Дополнительные материалы и заметки:

- Если при установке возникают проблемы — изучите логи в консоли и попробуйте запустить .bat файл от имени администратора.

- Для повторяемого рабочего процесса храните промпты, seed и настройки в отдельном текстовом файле рядом с итоговыми изображениями.

Спасибо за внимание — удачных экспериментов и безопасной работы с моделями!

Похожие материалы

Несколько аккаунтов Skype: Multi Skype Launcher

Журнал для работы: повысить продуктивность

Персональные звуки уведомлений на Android

Скачивание шоу Hulu для офлайн‑просмотра

Microsoft Start: персонализированная новостная лента