Как использовать ChatGPT API: руководство для разработчиков

Краткое определение

ChatGPT API — это интерфейс к моделям OpenAI (gpt-3.5-turbo, gpt-4 и их вариантам), который позволяет отправлять сообщения в режиме диалога и получать сгенерированный текст или структуированные ответы.

Важно: В одном предложении — API даёт вашему приложению возможность поддерживать «разговор» с мощными языковыми моделями.

Быстрый обзор — что вы получите из этого руководства

- Пошаговая инструкция по получению ключа и настройке Python-проекта.

- Примеры вызовов Chat Completion и использования режима JSON.

- Объяснение параметров модели: temperature, max_tokens и messages.

- Практические чек-листы, критерии приёмки, подходы к безопасности и примеры ошибок.

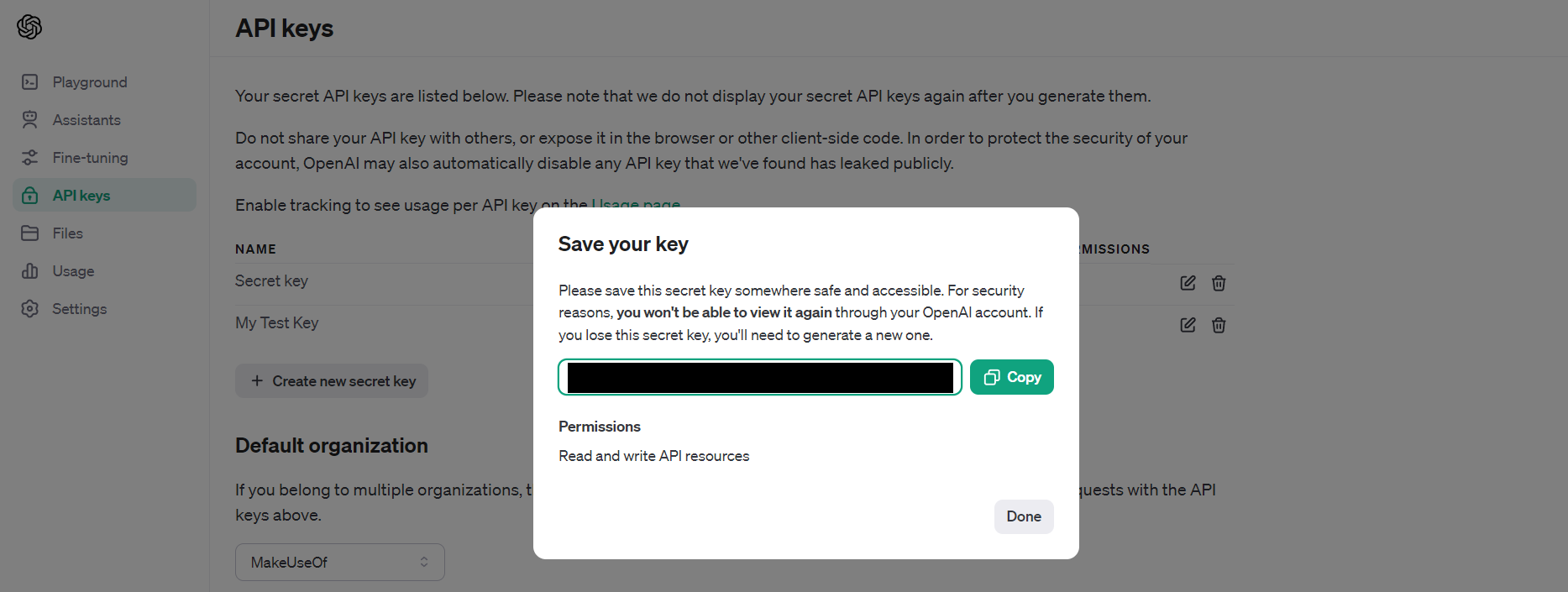

1. Получение ключа OpenAI

Чтобы начать работу с ChatGPT API, вам нужен API-ключ OpenAI.

- Зарегистрируйтесь или войдите в свою учётную запись на платформе OpenAI.

- В левой панели выберите вкладку API keys.

- Нажмите Create new secret key — будет сгенерирован секретный ключ.

- Скопируйте ключ и сохраните в безопасном месте: он больше не будет показан.

Совет: храните ключ вне репозитория (файл .env, менеджер секретов в облаке) и добавьте .env в .gitignore.

2. Настройка окружения для разработки (Python)

Мы используем Python и библиотеку openai (openai-python) в этом примере.

Шаги:

- Создайте виртуальное окружение Python.

- Установите библиотеки openai и python-dotenv:

pip install openai python-dotenv- Создайте файл .env в корне проекта и добавьте туда ключ:

OPENAI_API_KEY="YOUR_API_KEY"- Убедитесь, что .env входит в .gitignore.

Примечание: можно использовать и другие языки (JavaScript, Go и т.д.), либо вызывать HTTP API напрямую.

3. Отправка запросов в ChatGPT API

Модели GPT, используемые в ChatGPT (gpt-3.5-turbo, gpt-4 и их варианты), поддерживают диалоговый режим и текстовые completion.

GPT-4 Turbo и некоторые новые превью-модели поддерживают также обработку изображений (анализ, парсинг, транскрипция).

Обратите внимание: термин “ChatGPT API” в статье используется в общем смысле для API OpenAI, которые опираются на GPT-модели.

Пример запроса для chat completion (Python)

Ниже — пример, взятый из официальной библиотеки. Код показывает многотуровый диалог, роли сообщений и включение JSON-режима:

from openai import OpenAI

from dotenv import load_dotenv

load_dotenv()

client = OpenAI()

response = client.chat.completions.create(

model = "gpt-3.5-turbo-0125",

temperature = 0.8,

max_tokens = 3000,

response_format={ "type": "json_object" },

messages = [

{"role": "system", "content": "You are a funny comedian who tells dad jokes. The output should be in JSON format."},

{"role": "user", "content": "Write a dad joke related to numbers."},

{"role": "assistant", "content": "Q: How do you make 7 even? A: Take away the s."},

{"role": "user", "content": "Write one related to programmers."}

]

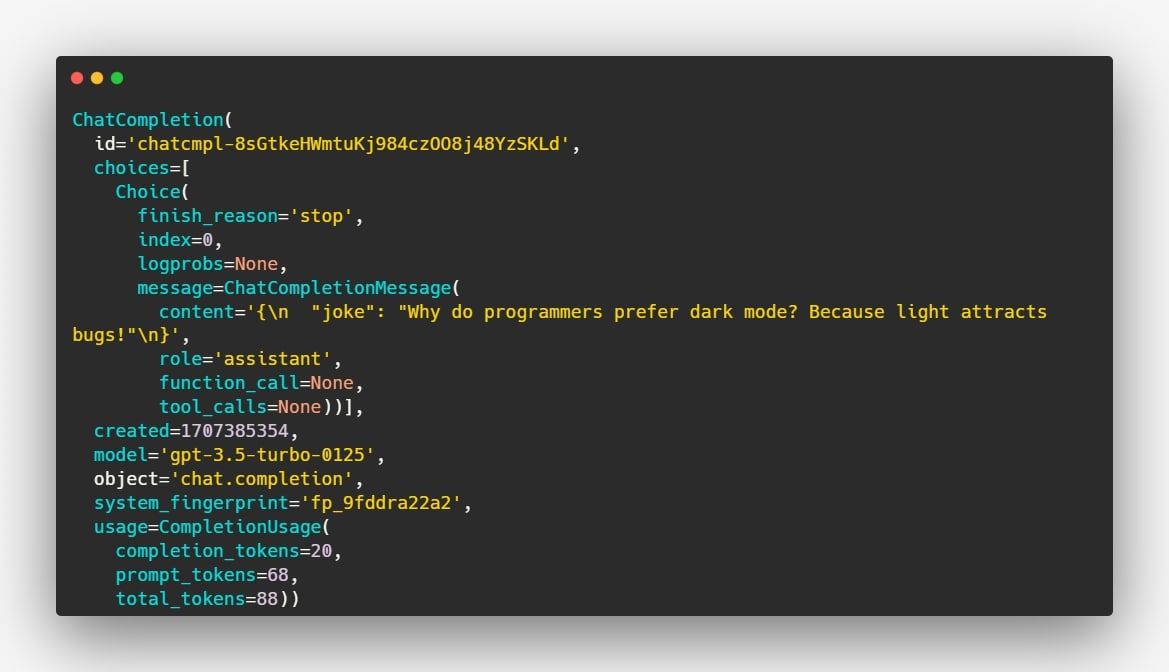

)Результат API возвращается как структура с choices — вы можете извлечь содержимое так:

print(response.choices[0].message.content)

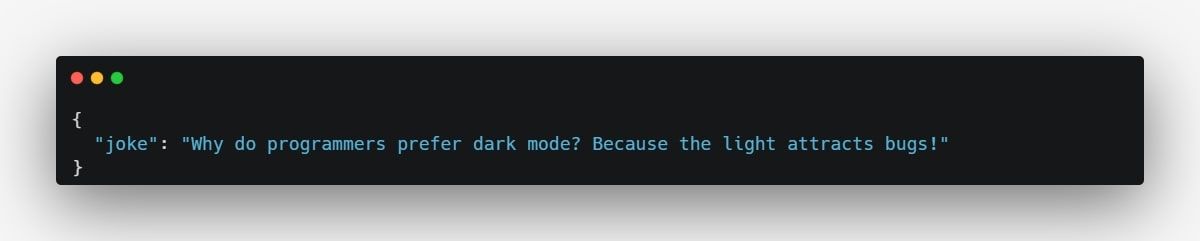

Пример вывода (шутка-программист):

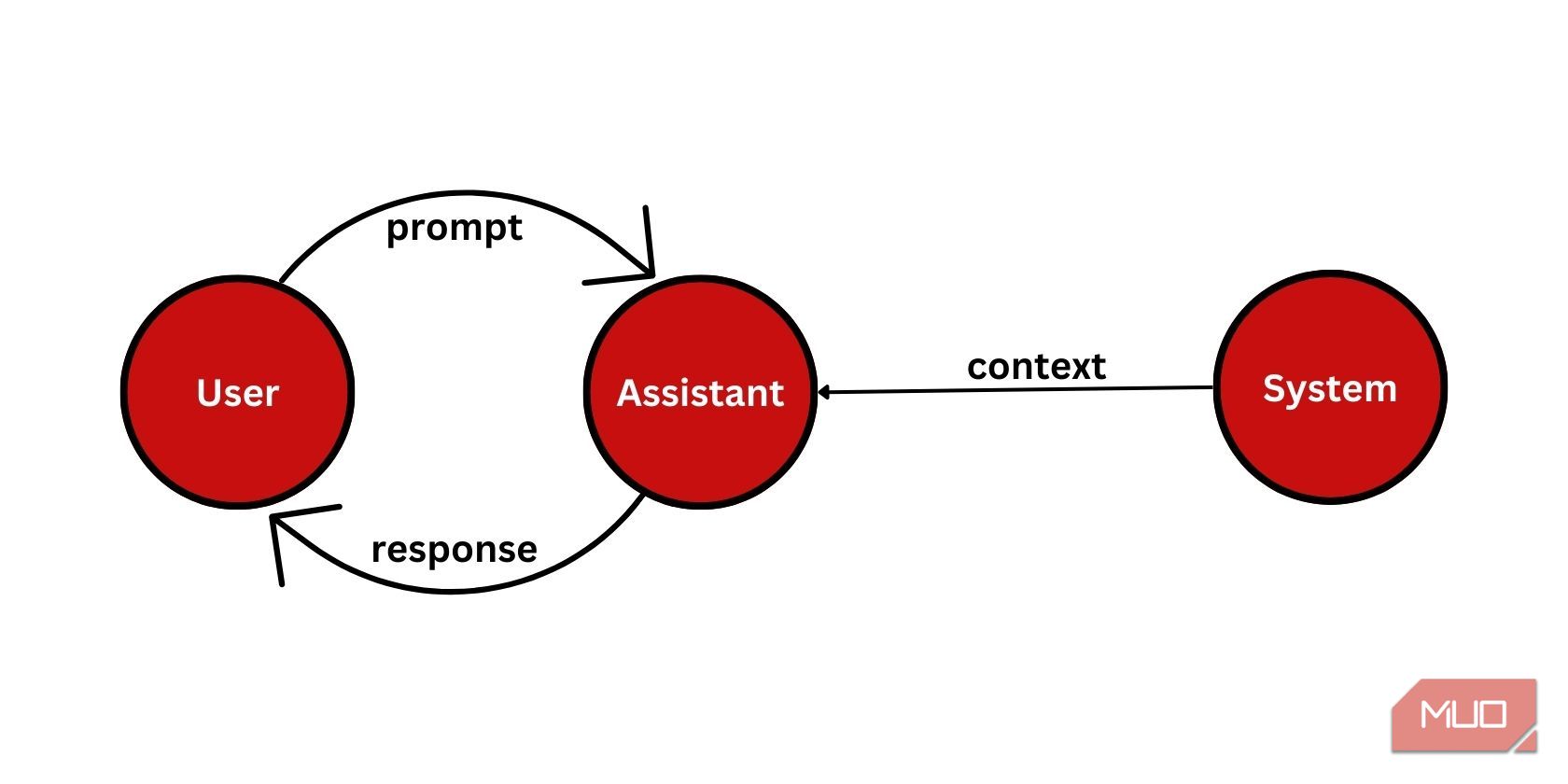

Ключевая часть конфигурации — параметр messages: массив объектов с полями role и content. Роли:

- system — настраивает поведение ассистента.

- user — инструкции от пользователя.

- assistant — примерные ответы или предыдущие ответы.

Параметры, на которые стоит обращать внимание

- temperature: управляет случайностью (0 — детерминированно, больше — креативнее). Диапазон: 0–2.

- max_tokens: ограничивает длину ответа. Очень низкое значение может обрезать ответ.

- response_format: при активированной JSON-режиме модель пытается вернуть корректный JSON ({ “type”: “json_object” }).

Обратите внимание на лимиты токенов: разные модели имеют разные контексты (см. факто-бокс ниже).

4. Использование ChatGPT API для текстового completion

Chat Completions API хорошо подходит и для одиночных запросов на генерацию текста. Пример:

from openai import OpenAI

from dotenv import load_dotenv

load_dotenv()

client = OpenAI()

response = client.chat.completions.create(

model = "gpt-3.5-turbo",

temperature = 0.8,

max_tokens = 3000,

messages = [

{"role": "system", "content": "You are a poet who creates poems that evoke emotions."},

{"role": "user", "content": "Write a short poem for programmers."}

]

)

print(response.choices[0].message.content)Даже если вы не передаёте роль system, достаточно одного user-персонажа:

messages = [

{"role": "user", "content": "Write a short poem for programmers."}

]

Факто-бокс: ключевые числа и понятия

- Платёж за доступ к GPT-4 часто требует успешной оплаты на сумму минимум $1 для активации доступа.

- 1000 токенов ≈ 750 слов (приблизительно).

- Примеры лимитов контекста (на момент написания):

- gpt-3.5-turbo: 4 096 токенов

- gpt-4: 8 192 токенов

- gpt-3.5-turbo-0125 и gpt-4-turbo-preview: 16 385 токенов или больше

- Некоторые превью-модели (например, gpt-4-turbo-preview) могут поддерживать до 128 000 токенов

Ценообразование — модель “за 1 000 токенов”

Цены вычисляются на основе входных и выходных токенов. 1 000 токенов — стандартная единица для тарифа. Пример из официальной документации:

| Model | Input | Output |

| gpt-4-0125-preview | $0.01 / 1K tokens | $0.03 / 1K tokens |

| gpt-4-1106-preview | $0.01 / 1K tokens | $0.03 / 1K tokens |

| gpt-4-1106-vision-preview | $0.01 / 1K tokens | $0.03 / 1K tokens |

| gpt-4 | $0.03 / 1K tokens | $0.06 / 1K tokens |

| gpt-4-32k | $0.06 / 1K tokens | $0.12 / 1K tokens |

| gpt-3.5-turbo-0125 | $0.0005 / 1K tokens | $0.0015 / 1K tokens |

| gpt-3.5-turbo-instruct | $0.0015 / 1K tokens | $0.0020 / 1K tokens |

Примечание: цены подвержены изменениям. Всегда проверяйте актуальные тарифы на сайте OpenAI.

Когда использование ChatGPT API не подойдёт (контрпримеры)

- Требуется строгое вычислимое и полностью верифицируемое поведение (например, финансовые расчёты с юридической ответственностью). Модели LLM не дают гарантий абсолютной точности.

- Системы с крайне низкой толерантностью к ошибке в безопасности (например, критические системы управления промышленным оборудованием) — рискованно полагаться на генеративную модель без дополнительной валидации.

- Высокочувствительные персональные данные без юридической проверки на соответствие требованиям конфиденциальности.

Альтернатива: гибридный подход — локальная модель для чувствительных операций + облачная модель для генерации естественного языка.

Альтернативные подходы и модели

- Локальные открытые модели (Llama, Mistral, Bloom) — контроль данных и отсутствие сетевых задержек, но потребуют ресурсов и дообучения.

- Комбинация: небольшая локальная модель для фильтрации/валидации + облачная модель для генерации.

- Специализированные API (Speech-to-Text, OCR, классификация) — использовать вместе с ChatGPT для полного решения (например, сначала OCR изображения, затем отправить текст в модель).

Ментальные модели и эвристики для проектирования

- “Prompt → Context → Constraint”: сначала формулируйте намерение (prompt), затем обеспечьте нужный контекст (system/user examples), затем задайте ограничения (temperature, max_tokens, response_format).

- Минимизируйте длину контекста, удаляя устаревшую информацию перед отправкой — это экономит токены.

- Для структурированных ответов используйте JSON-режим и валидацию на стороне сервера.

Безопасность, приватность и соответствие требованиям

Важно:

- Не храните секреты в коде. Используйте секретные менеджеры или защищённые переменные окружения.

- Если вы обрабатываете персональные данные EU/EEA, проверьте соответствие GDPR и условия обработки данных OpenAI. Технически стоит минимизировать передачу персональных данных и уважать права субъектов данных.

- Реализуйте фильтрацию входных данных и постобработку ответов, чтобы предотвращать утечки конфиденциальной информации и генерацию вредоносного контента.

Рекомендации:

- Логируйте запросы и ответы с маскированием чувствительных полей.

- Проводите регулярные ревью подсистем безопасности и доступов.

Чек-листы по ролям

Чек-лист для разработчика:

- Получил и безопасно сохранил OPENAI_API_KEY

- Настроил виртуальное окружение и зависимости

- Покрыл критические пути unit-тестами

- Настроил обработку ошибок и таймаутов

Чек-лист для продакт-менеджера:

- Определил примеры промптов и сценарии использования

- Решил, какие ответы нужно валидировать вручную

- Оценил бюджет по токенам

Чек-лист для специалиста по безопасности:

- Провёл оценку рисков передачи данных

- Настроил ротацию ключей и доступы

- Определил процедуру инцидента и отката

Критерии приёмки

- Интеграция успешно аутентифицируется с OpenAI и возвращает ожидаемые ответы в >95% тестовых промптов.

- Обработка ошибок: при недоступности API приложение деградирует корректно (fallback) и логирует инцидент.

- Ответы проходят валидацию JSON (если включён JSON-режим) и соответствуют схеме.

- Производительность: среднее время ответа укладывается в целевой SLA (например, <1.5 с для интерактивных сценариев).

Шаблон запроса и валидация JSON (рекомендация)

- Формируйте schema для ожидаемого JSON (пример: поле title:string, tags:array).

- В prompt укажите: “Return only valid JSON that matches this schema.” и используйте response_format для строгой выдачи.

- На сервере валидируйте JSON через стандартные библиотеки (pydantic, jsonschema).

Примеры ошибок и как их отлавливать

- Ошибка доступа к модели (“The model

gpt-4does not exist or you do not have access to it”) — чаще всего связано с отсутствием доступа или неоплаченной подпиской. - Ошибки превышения лимита токенов — уменьшите контекст или переключитесь на модель с большим контекстом.

- Некорректный JSON — усиливайте инструкцию и добавьте проверку и повторный запрос с конкретной ошибкой парсинга.

Пример плана миграции на новую модель

- Прототипирование: протестируйте на dev-аккаунте новую модель (gpt-4-turbo-preview).

- A/B тест: часть запросов идёт на старую модель, часть — на новую.

- Сравнение качества и латентности (SLO): если новая модель стабильна, переключаемся полностью.

- Мониторинг затрат: проверьте влияние на бюджет.

Часто задаваемые вопросы

Как получить доступ к GPT-4?

Нужна успешная оплата (минимум $1 в момент активации) и доступ в вашей учётной записи OpenAI.

Могу ли я использовать ChatGPT API для коммерческого продукта?

Да, при соблюдении лицензионных и платёжных условий OpenAI. Проверьте ограничения в соглашении и политику контента.

Как минимизировать расходы на токены?

Короткие промпты, сжатие контекста (удаление неактуальных сообщений), кеширование ответов и выбор более дешёвых моделей для непроизводительных задач.

Короткое резюме

ChatGPT API даёт гибкий интерфейс для интеграции диалоговых возможностей в приложения. Основные шаги — получить ключ, настроить окружение, выбрать модель и параметры, реализовать валидацию ответов и обеспечить безопасность данных. Для надёжной работы используйте схемы валидации, мониторинг и чек-листы по ролям.

Важно: тестируйте поведение модели в ваших сценариях, особенно для критичных бизнес-процессов.

Похожие материалы

Scam Likely: что это и как блокировать звонки

Безопасность менеджера паролей Chrome: руководство

Как разблокировать SIM на Android — инструкция

Deepfake: как использовать, угрозы и защита

Резервное копирование SMS на Android