Как распознать российских ботов и платных пропагандистов в социальных сетях

Кратко: Вы узнаете, чем отличаются боты и шиллы, какие признаки выдают автоматизированные и оплачиваемые аккаунты, и как действовать, если вы их обнаружили. Основные приёмы — анализ частоты и шаблонов публикаций, проверка профиля и сетевого поведения, и систематическая отчётность платформам.

Важно: под «шиллом» понимается реальный человек, который получает оплату за продвижение точек зрения. Под «ботом» — автоматизированный аккаунт, настроенный публиковать или ретвитить контент по заданным правилам.

Почему это важно

Манипуляции в соцсетях влияют на общественное мнение, выборы, деловую репутацию и безопасность сообществ. За последние годы примеры вмешательства — от организованных тролль‑ферм до скоординированных сетей ботов — показали реальное влияние на дискуссии и повестки.

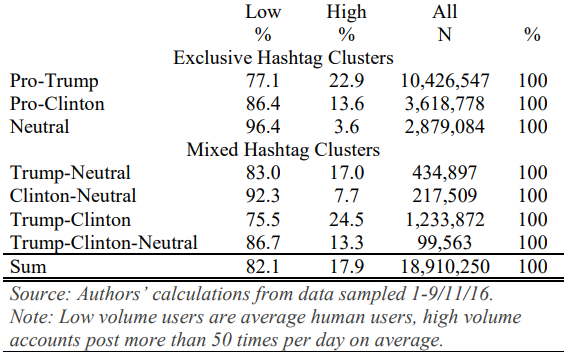

Ключевые факты из публичных отчётов:

- Специальный прокурор Роберт Мюллер выдвинул обвинения против группы, связанной с предполагаемой российской пропагандистской машиной Internet Research Agency.

- Twitter сообщал, что уведомил 677 775 пользователей США, которые ретвитнули содержание IRA.

- Исследования оценивали долю автоматизированных ботов в Twitter примерно в 15%, что оценивается более чем в 40 миллионов аккаунтов (оценки исследований разнятся).

Боты и шиллы: краткие определения

- Бот — автоматизированный аккаунт, программно публикующий, ретвитящ, лайкающий или голосующий с целью усилить определённую повестку.

- Шилл — реальный человек, получающий оплату за продвижение идей, брендов или политических сил, действующий как «обычный» пользователь.

Оба типа могут работать совместно: боты создают видимость массовой поддержки, шиллы — вносят человеческий контент и персональную вовлечённость.

История и примеры

Русские боты и шиллы активно обсуждались в контексте выборов 2016 года в США. В ряде публичных дел фигурировали создаваемые американские идентичности, похищение личных данных и создание провокационных групп для эскалации конфликтов. Один известный пример — инцидент с протестами у Da’wah Center в Хьюстоне, когда оба противоборствующих сообщества оказались подложными организациями, связанными с тролль‑фермой.

Как работают сети влияния: модель работы

Модель влияния обычно включает несколько уровней:

- Создание базовой сети аккаунтов (авто- и полуавтоматизированных).

- Координация тем и хэштегов.

- Придание видимости массовости (ретвиты, лайки, комментирование).

- Человеческое сопровождение — шиллы встраиваются в сообщества, способны менять тон и переводить разговор в нужное русло.

Признаки бота: подробный чеклист

- Публикации почти исключительно в ретвитах и репостах, без оригинального контента.

- Повторяющиеся тексты или ссылки с небольшими изменениями.

- Высокая частота публикаций с минимальными паузами (машинная регулярность).

- Публикации, реагирующие на «триггерные» новости быстрее, чем это возможно человеку.

- Отсутствие персональных фото или использование стоковых/поддельных изображений.

- Профили с нулевым или минимальным количеством друзей/подписок при высокой активности.

- Синхронная активность нескольких аккаунтов (одинаковые сообщения одновременно).

- Манипуляции с голосованиями/системными метриками (массовые автоматические даунвоты).

- Профили, активные только вокруг крупных событий и полностью молчащие в остальное время.

Пример сценария обнаружения бота:

- Вы видите резкий всплеск ретвитов по хэштегу.

- Сравниваете временные метки — десятки аккаунтов публикуют идентичное сообщение в течение нескольких секунд.

- Проверяете профили — многие без персональной информации, с похожими шаблонными именами.

Признаки шилла: подробный чеклист

- Постоянное продвижение одной темы или точки зрения в разных обсуждениях.

- Попытки переводить разговор в заранее подготовленное русло.

- Частые личностные атаки, «whataboutism» и перенос фокуса.

- Инфильтрация в тематические группы и постепенное завоевание доверия.

- Публикации в разное время суток без учёта человеческих циклов (24/7 активность может быть организована командой).

- Наличие финансовых или профессиональных мотиваций (жёстко ориентированная PR‑кампания, связь с агентствами).

Шиллы заметнее по содержанию и стилю, но маскируются под обычных пользователей.

Методы проверки аккаунта: практическая методология

Малый чеклист для быстрой проверки (5–10 минут):

- Просмотрите историю публикаций — есть ли оригинальный контент?

- Посмотрите частоту и регулярность сообщений — есть ли признаки автоматизации?

- Проверьте дату создания аккаунта и резкий рост активности.

- Поиск изображений профиля через обратный поиск картинок (проверка уникальности фотографии).

- Анализ сети — с кем взаимодействует аккаунт (похожие аккаунты, бот‑кластеры).

- Поиск имён/емейлов/UID в открытых базах и базах утёков (при наличии технических навыков).

Короткая методика для глубокой проверки (30–60 минут):

- Скачайте временные метки публикаций и визуализируйте пики активности.

- Выделите часто повторяющиеся фразы/ссылки.

- Сравните стиль и лексикон с другими аккаунтами в сети.

- Используйте инструменты сетевого анализа (Gephi, NodeXL) для обнаружения кластеров.

Роли и чеклисты: кому что делать

Роль — обычный пользователь

- Не вступайте в ссоры с подозрительными аккаунтами.

- Сохраняйте доказательства (скриншоты, URL).

- Сообщайте о подозрительных профилях платформе.

Роль — модератор сообщества

- Внедрите правило проверки новых активных участников.

- Обращайте внимание на массовые однообразные комментарии.

- Координируйтесь с другими модераторами и делитесь шаблонами для жалоб.

Роль — журналист или исследователь

- Соберите метаданные и сделайте сетевой анализ.

- Проверьте IP/геолокацию, если доступны логи.

- Используйте архивы (Wayback, Google Cache) для проверки истории.

Роль — администратор платформы

- Внедрите алгоритмы обнаружения аномалий активности.

- Разработайте прозрачные процессы апелляции для легитимных пользователей.

- Проводите публичные отчёты о действиях против сетей манипуляции.

Практический SOP для отметки и отчёта о боте/шилле

- Сохраните первичные данные: URL профиля, ID поста, временная метка.

- Сделайте скриншоты беседы и профиля (включая метаданные, если можно).

- Проверьте сеть связанных аккаунтов (репосты, одинаковые тексты).

- Отправьте жалобу на платформу, приложив доказательства и описав подозрения.

- Если речь о крупной манипуляции, уведомите профильные организации и СМИ.

- Архивируйте материалы для возможного последующего анализа.

Критерии приёмки: жалоба должна содержать URL, скриншоты и краткое описание наблюдаемого паттерна.

Решение: алгоритм действий для обычного пользователя

- Шаг 1: Если пост трогает вас эмоционально — сделайте паузу.

- Шаг 2: Проверьте профиль по чеклисту бота/шилла.

- Шаг 3: Не распространяйте сомнительный контент без верификации.

- Шаг 4: Сообщите платформе и при необходимости модераторам сообщества.

- Шаг 5: Поделитесь своими выводами в верифицированном источнике, если вы исследователь.

flowchart TD

A[Увидели вызывающий пост] --> B{Проверить источник}

B -->|Профиль похож на бота| C[Собрать доказательства и пожаловаться]

B -->|Профиль похож на шилла| D[Оставить заметку и наблюдать за сетью]

B -->|Ничего подозрительного| E[Проверить факт‑чекинг и не ретвитить]

C --> F[Архивировать и уведомить модераторов]

D --> F

E --> G[Поделиться ссылкой на проверенные источники]Когда методы не работают: ограничения и контрпримеры

- Умелые операторы сочетают автоматизацию и людей. Они создают гибридные аккаунты с правдоподобной активностью.

- Платформы не всегда быстро реагируют — процессы апелляции и расследования занимают время.

- Некоторые тактики маскируются под локальные субкультуры, что затрудняет автоматическое обнаружение.

Важно понимать: ни один показатель сам по себе не доказывает принадлежность к «тролль‑ферме». Надёжный вывод требует совокупности признаков.

Этические и юридические соображения

- Помните о правах реальных людей и не обвиняйте публично без доказательств.

- Храните доказательства корректно и не нарушайте законы о личных данных при их сборе.

- Если вы журналист или исследователь, следуйте редакционной политике по публикации результатов.

Риски и меры противодействия

Риски

- Поляризация и радикализация аудиторий.

- Манипуляция результатами голосований и общественными настроениями.

- Урон репутации частных лиц и организаций.

Меры

- Обучение пользователей критическому мышлению.

- Технические средства обнаружения аномалий активности.

- Совместные отраслевые расследования и публичное разоблачение сетей.

Мини‑методология исследования аккаунта (шаблон для аналитиков)

- Сбор: экспортировать посты и комментарии аккаунта за период X.

- Очистка: удалить стоп‑слова и нормализовать текст.

- Анализ частоты: построить временные ряды публикаций.

- Кластеризация: найти похожие аккаунты по лексике и времени публикаций.

- Верификация: обратный поиск изображений и проверка метаданных.

- Документация: собрать отчёт с выводами и рекомендациями.

Критерии приёмки обнаружения сети манипуляции

- Наличие 3+ признаков из чеклистов ботов/шиллов.

- Корреляция активности с другими подозрительными аккаунтами.

- Повторяемость шаблонов сообщений/ссылок.

Если все три критерия выполняются — сеть стоит отметить как кандидата на блокировку/дальнейшее расследование.

Тесты и приёми: как проверить детектор ботов

- Тест 1: вставьте в систему набор известных бот‑аккаунтов и проверьте чувствительность.

- Тест 2: проверьте ложную тревогу на выборке реальных активных пользователей.

- Тест 3: имитируйте гибридные аккаунты (частично автоматизированные) и оцените устойчивость.

Критерии успеха: высокая точность для известных шаблонов и приемлемая сложность апелляции для пользователей.

Глоссарий (1‑строчные определения)

- Астротёрфинг — создание искусственной массовой поддержки, маскируя её под «органическое» движение.

- Тролль‑ферма — организация, координирующая большое количество аккаунтов для пропаганды.

- Whataboutism — перевод обсуждения на другой объект критики с целью отвлечь.

- Даунвот — негативный голос в системах рейтинга комментариев, используемый для сокрытия мнений.

Советы для разных аудиторий

- Журналисты: документируйте, публикуйте источники и не делайте поспешных обвинений.

- Активисты: проверяйте новых членов, не допускайте единогласных «ботовых» атак.

- Обычные пользователи: думайте прежде чем ретвитить, проверяйте источники.

Что делать, если вы обнаружили массовую манипуляцию

- Не распространяйте контент.

- Соберите и сохраните доказательства.

- Сообщите платформе и, при серьёзном вмешательстве, профильным организациям и медиа.

- Поделитесь выводами в доверенных каналах для коллективной проверки.

Важно: обвинения в адрес реальных людей могут навредить невинным. Работайте с доказательствами и прозрачностью.

Image Credit: raptorcaptor/ Depositphotos

Итог

Знание признаков ботов и шиллов помогает фильтровать манипулятивную информацию. Полезна комбинация простых приёмов (проверка профиля, частоты публикаций, обратный поиск изображений) и более глубокого анализа (кластеризация аккаунтов, визуализация временных рядов). Сообщайте о подозрениях платформам и придерживайтесь этики в публичных обвинениях.

Короткая памятка:

- Не ретвитьте сомнительное без проверки;

- Сохраняйте доказательства;

- Сообщайте платформе;

- Будьте осторожны с публичными обвинениями.

Спасибо за внимание — будьте внимательны в онлайне и сохраняйте критическое мышление.

Похожие материалы

Как удалить и восстановить файлы на Chromebook

Включить Controlled folder access в Windows

M1 Mac и износ SSD: проверка и действия

Email подпись и тёмный режим: чтобы всё выглядело правильно

MyPermissions: очистка разрешений приложений