Риски и признаки текста, сгенерированного ИИ

В последние годы большие языковые модели (LLM), такие как ChatGPT и их аналоги, превратились в удобный инструмент для автоматической генерации текстов: от заметок и пресс-релизов до рекламных сообщений. Они обучены на огромных корпусах данных — веб‑страницах, статьях и обсуждениях — и умеют строить тексты, похожие на человеческие.

Однако у автоматической генерации есть свои ограничения и риски. Этот материал подробно рассматривает: какие проблемы может вызвать использование ИИ‑текста, как распознать машинно сгенерированный контент, когда и как безопасно применять ИИ в рабочем процессе, а также предлагает практические шаблоны и процедуры для команд.

Основные опасности использования ИИ для создания текстов

Ниже — расширённое объяснение пяти ключевых рисков, а также конкретные последствия и рекомендации по снижению ущерба.

1. Дезинформация и неверные факты

ИИ генерирует последовательности слов, которые выглядят правдоподобно, но не гарантируют достоверность. Модель не «знает» правду: она предсказывает, какие слова обычно следуют в тексте по обучающим данным.

Риски:

- Ошибочные утверждения о здоровье, финансах или юридических вопросах, которые могут причинить вред.

- Уверенные, но неверные формулировки, которые трудно отличить от истины без проверки.

Как снижать риск:

- Всегда проверяйте факты из первичных источников (научные статьи, официальные сайты, регуляторы).

- Для критичных тем используйте экспертов‑проверку перед публикацией.

Важно: для контента о здоровье, безопасности и финансах практика «проверил источник — публикуй» обязательна.

2. Проблемы качества и риск плагиата

Модели учатся на существующих текстах и иногда могут бессознательно воспроизводить фрагменты или структуры исходных материалов.

Последствия:

- Неровная стилистика, отсутствие логической связки между абзацами.

- Риск непреднамеренного плагиата или некорректного цитирования.

Рекомендации:

- Прогоняйте текст через плагиат‑чекер и ручную редактуру.

- Используйте ИИ как источник идей или черновик, но не как финальный текст.

3. Алгоритмы поисковых систем и понижение ранжирования

Поисковые системы приоритизируют полезный, оригинальный контент для людей. Контент, который выглядит как «скопированный» или бесполезный, может потерять видимость.

Как избежать:

- Смешивайте результаты ИИ с уникальными инсайтами и опытом команды.

- Добавляйте исследования, кейсы и авторские комментарии, которые нельзя сгенерировать из открытых данных.

4. Отсутствие оригинальных идей и персонализации

ИИ опирается на усреднённые паттерны: для задач, где ценится уникальная перспектива или личный опыт, модель уступает человеку.

Что делать:

- Ставьте задачу так, чтобы ИИ помогал структурировать мысли, а не заменял уникальный взгляд автора.

- Просите сотрудников добавлять личные истории, кейсы и выводы.

5. Репутационный риск и размывание голоса бренда

Ошибочный или «безликий» текст может вызвать недоверие аудитории и ослабить узнаваемость бренда.

Практические меры:

- Определите набор тонов и словарных единиц бренда, которые обязательны для ручной правки.

- Назначьте ответственного редактора за соответствие голосу бренда.

Как распознать текст, сгенерированный ИИ

Ниже — расширенный набор признаков и практических проверок, от простых инспекций до инструментов.

1. Повторение слов и фраз

Признаки:

- Частое повторение служебных слов или одинаковых оборотов.

- Заметные ритмические паттерны или формулы (введение — список — заключение) и повторяющийся словарь.

Совет:

- Сделайте быструю простую проверку: если при медленном прочтении возникает ощущение монотонности или «скелетности» текста — отправляйте на редактуру.

2. Неестественные переходы и структурные ошибки

Признаки:

- Резкие смены темы внутри абзаца.

- Логические несоответствия между фактами и выводами.

Практика:

- Пройдите чек‑лист структуру: цель абзаца -> поддерживающий факт -> вывод. Если связки ломаются — возможен ИИ‑черновик.

3. Сухой, фактологический стиль без глубины

Признаки:

- Много фактов и мало анализа, отсутствуют личные суждения и контекст.

- Текст пригоден для быстрого чтения, но не вызывает вовлечения.

Проверка:

- Оценивайте баланс «факт:анализ». Если соотношение близко к 80:20 в пользу фактов — возможен ИИ.

4. Отсутствие эмоций и личного опыта

Признаки:

- Тон ровный, эмоциональные акценты кажутся натянутыми.

- Нет личных кейсов, ссылок на конкретный опыт автора.

Проверка:

- Запросите у автора конкретный пример или три наблюдения из практики; если не могут привести — тексты возможно сгенерированы.

5. Инструменты для обнаружения

Методы:

- Статические инструменты: GPT‑2 Output Detector, GLTR, GPTZero — показывают признаки машинного формирования.

- Плагиат‑чекеры: выявляют совпадения с публичным контентом.

- Ручная экспертиза: редакторская проверка фактов и стиля.

Важно: ни один инструмент не даёт 100% гарантии; лучше комбинировать автоматические и ручные проверки.

Когда ИИ хорошо работает — и когда он терпит неудачу

Контекст важен. Ниже — примеры подходящих и неподходящих сценариев.

Подходит для:

- Генерации идей и заголовков.

- Создания черновых структур (план статей, тезисы).

- Быстрой подготовки шаблонных текстов (служебные письма, инструкции с ограниченным набором вариантов).

Не подходит для:

- Контента на темы здоровья, права, инвестиций без экспертизы.

- Брендовых историй, личных кейсов, аналитики с авторским мнением.

- Материалов, где важна оригинальная исследовательская работа.

Контрпример (когда ИИ ошибается): при попытке написать научный обзор модель может смешать выводы нескольких исследований и представить противоречивые или неверные утверждения как консенсус.

Альтернативные подходы к созданию контента

- Человеко‑центрированный рабочий процесс: идеи генерирует ИИ, а финальную версию пишет или правит человек.

- Гибридный редакторский цикл: ИИ делает первый драфт, редактор верифицирует факты и адаптирует тон.

- Модульный контент: публикуйте части, где ИИ приемлем (факты, списки), и добавляйте авторские блоки (анализ, кейсы).

Модель мышления для принятия решения

Используйте простую эвристику: влияние × критичность.

- Если влияние на читателя высоко (здоровье, деньги) и критичность велика — не доверять ИИ без эксперта.

- Если влияние низкое и задача повторяющаяся — ИИ может быть оправдан.

Решающее дерево для выбора способа использования ИИ

flowchart TD

A[Нужно ли публиковать?] --> B{Тема критична для здоровья/финансов/прав}

B -- Да --> C[Только экспертная подготовка и ручная верификация]

B -- Нет --> D{Нужен оригинальный личный опыт}

D -- Да --> C

D -- Нет --> E{Требуется уникальная аналитика}

E -- Да --> C

E -- Нет --> F[Можно использовать ИИ как черновик]

F --> G[Обязательная проверка фактов и редактура]

G --> H[Публикация с пометкой и прозрачностью]

C --> HРоли и чек-листы: кто за что отвечает

Чек-лист для редактора:

- Проверить факты в первоисточниках.

- Оценить соответствие голосу бренда.

- Сверить текст с политикой компании по чувствительным темам.

Чек-лист для маркетолога:

- Оценить SEO‑ценность и уникальность контента.

- Решить, какие блоки могут быть автоматизированы.

Чек-лист для разработчика/инженера данных:

- Настроить контроль версий генерации (логирование запросов и ответов).

- Организовать безопасное хранение и доступ к API ИИ.

SOP: безопасное использование ИИ в процессе создания контента

- Цель: сэкономить время на рутинных задачах и сохранить качество.

- Входные данные: четкий бриф, лист источников, целевая аудитория и требования по тону.

- Генерация черновика: использовать контролируемые подсказки (prompts) и фиксированный шаблон.

- Фактчекинг: ручная проверка ключевых утверждений по первоисточникам.

- Редактура: адаптация голоса бренда и добавление авторского контента.

- Юридическая проверка: для материалов на чувствительные темы.

- Публикация: тегирование контента (например, «создано с помощью ИИ» — по политике компании).

- Мониторинг: отслеживание откликов аудитории и метрик вовлечения.

План реагирования на инциденты и откат публикации

- Обнаружение: сигнал от пользователя, службы модерации или внутренней проверки.

- Оценка риска: кто пострадал, какой масштаб, нужна ли срочная приостановка.

- Отключение: временно снять публикацию или поставить метку «на проверке».

- Расследование: кто готовил, какие подсказки использовались, были ли верификации.

- Исправление: отредактировать текст, добавить ссылки на источники, исправить ошибки.

- Коммуникация: публичное объяснение шагов по исправлению и извинение, если необходимо.

- Пост‑мортем: обновить SOP и провести обучение сотрудников.

Критерии приёмки для статей, в которых использовался ИИ

- Все факты подтверждены по минимум двум авторитетным источникам.

- Текст прошёл редакторскую правку и соответствует голосу бренда.

- Нет подозрений на плагиат (проверка пройдена).

- Для чувствительных тем получено экспертное одобрение.

Тестовые случаи и приёмочные проверки

Примеры тестов:

- Фактический тест: заменить 3 ключевых утверждения ссылками на первоисточники.

- Стилевой тест: сравнить язык статьи с эталонным тоном бренда (автоматически или вручную).

- Тест уникальности: пройти через три разных плагиат‑сервиса.

Шаблоны подсказок и готовые фрагменты

Пример безопасного запроса к модели (prompt):

- «Сгенерируй план статьи на 800 слов по теме X. Включи 3 блока: обзор, примеры, практические рекомендации. Не добавляй медицинские или юридические советы. Для фактов оставь метки [ПРОВЕРИТЬ].»

Шаблон для пометки публикации:

- “Часть этого материала подготовлена с использованием инструментов искусственного интеллекта. Все ключевые факты были проверены редакцией.”

Ограничения и когда не доверять инструментам‑детекторам

- Детекторы часто ошибаются на коротких фрагментах и могут давать ложные срабатывания на академический стиль.

- Новые модели могут обходить простые детекторы — полагайтесь на комбинированную проверку.

Факто‑бокс: ключевые соображения для принятия решения

- Влияние на аудиторию: высокий → ручная верификация обязательна.

- Уровень оригинальности: важен → минимум человеческого редактирования.

- Юридический риск: высок → консультируйтесь с юристом.

Советы по безопасности и приватности

- Не передавайте в открытые модели конфиденциальную информацию о клиентах.

- Храните логи подсказок и ответов в закрытой системе для аудита.

Краткое руководство для руководителя контент‑команды

- Установите политику: где ИИ допустим, где нет.

- Назначьте владельца процесса и критерии приёмки.

- Обучите редакторов: как проверять ИИ‑тексты.

- Внедрите мониторинг: метрики качества контента.

Заключение

ИИ — мощный инструмент для ускорения создания контента, но он не заменит экспертную проверку и человеческую креативность. Без продуманной политики и процедур автоматическая генерация способна привести к дезинформации, потере голосa бренда и проблемам с поисковым ранжированием. Практика «ИИ как ассистент плюс люди как контролёры» даёт наилучший баланс эффективности и надёжности.

Важно: начните с пилота, определите безопасные зоны применения и применяйте описанные SOP и чек-листы для минимизации рисков.

Краткие выводы и действия:

- Используйте ИИ для черновиков и идей.

- Всегда верифицируйте факты по первоисточникам.

- Назначьте ответственного редактора и ведите логи запросов.

Похожие материалы

Убрать раздражающие функции Facebook — руководство

Приложения по умолчанию на Android — настройка и управление

Установить REMnux в VirtualBox — руководство

Список выполненного: мотивация и шаблоны

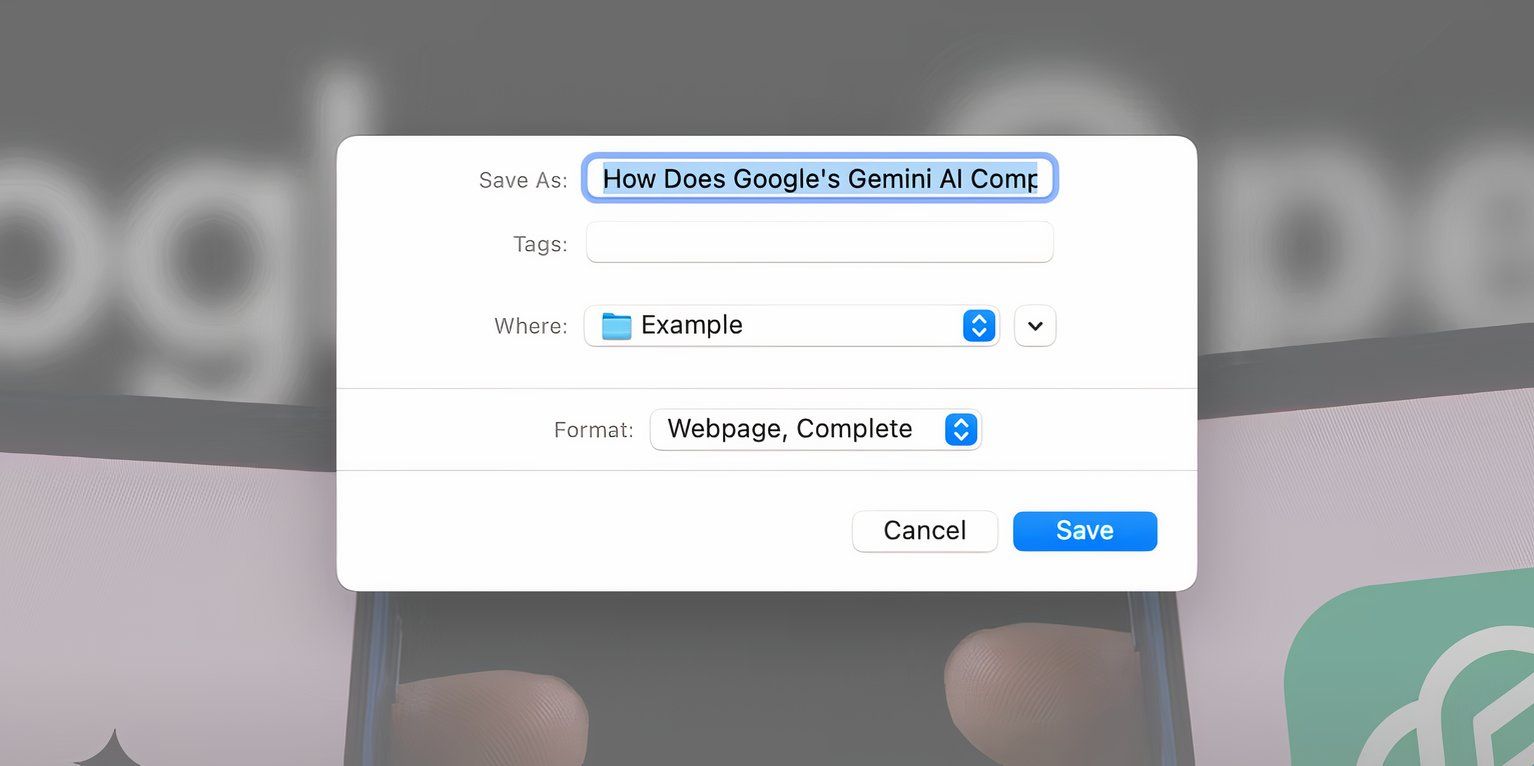

Как сохранить веб‑страницу для офлайн‑чтения