Как распознать изображение, созданное ИИ

В последние годы генеративные модели изображений — такие как DALL-E, Midjourney и Stable Diffusion — стали настолько хороши, что визуально отличить фотографию от изображения, созданного ИИ, стало сложнее. Тем не менее существуют маркеры и методики, которые помогают определить, было ли изображение создано алгоритмом. В этой статье мы подробно разберём шаги, признаки, инструменты и практические проверки, а также приведём чек-листы и сценарии для разных ролей.

Важно: определение происхождения изображения часто требует сочетания приёмов — ни один метод не даёт 100% гарантии.

Что такое изображение, созданное ИИ

Короткое определение: изображение, созданное ИИ, — это визуальный файл, генерированный или существенно изменённый при помощи алгоритмов генеративного машинного обучения (GAN, диффузионные модели и т.д.).

Ключевые понятия в одну строку:

- Генеративная модель — алгоритм, создающий новый контент на основе обучения на большом наборе примеров.

- Водяной знак — встроенный идентификатор, который добавляет разработчик сервиса.

- Артефакт — нежелательная визуальная аномалия, типичная для моделей.

1. Проверьте заголовок, описание, теги и комментарии

Многие авторы честно указывают, что изображение создано с помощью ИИ. Это можно найти в:

- заголовке публикации;

- описании к изображению;

- хештегах (например, #AI, #Midjourney, #DallE);

- комментариях, где автор может привести полный текст подсказки (prompt);

- профиле пользователя (часто видно, какие инструменты использует автор).

Некоторые площадки вводят отдельные категории для изображений, созданных ИИ. При сомнении посмотрите на теги и категорию. Если вы видите слова Midjourney, DALL-E или Stable Diffusion — это прямой сигнал.

Совет по локализации: на русскоязычных платформах могут использоваться хештеги вида #ИИ, #искусственныйинтеллект, #midjourney.

2. Ищите водяные знаки и служебные метки

Некоторые сервисы автоматически добавляют водяной знак к скачанным изображениям. Например, DALL-E ставит небольшую эмблему в углу. Но важный нюанс: водяные знаки можно удалить, и их отсутствие не доказывает, что изображение не сгенерировано.

Что следует учитывать:

- Если виден водяной знак платформы — изображение сгенерировано или прошло через сервис.

- Отсутствие водяного знака не исключает генерации; автор мог удалить знак или использовать сервис без маркировки.

- Правила платформы и лицензии иногда разрешают удаление водяных знаков, но не разрешают вводить в заблуждение о происхождении изображения.

3. Ищите характерные искажения и артефакты

Генеративные модели часто ошибаются в деталях, особенно в тех областях, которые требуют сложной структуры и согласованности. К типичным признакам относятся:

- искажения в руках (лишние или сросшиеся пальцы, неестественные суставы);

- несимметричность лица (разная высота глаз, зубы не по центру);

- аксессуары, которые будто «проваливаются» в кожу (очки, серьги);

- текст на изображении трудно читаем или превращается в бессмысленный набор символов;

- участки выглядят как мазки краски, особенно на близком рассмотрении;

- фоны кажутся текстурой, а не реально сфотографированной глубиной сцены.

Ментальная модель: генератор хорошо «рисует» общую структуру и стиль сцены, но слабеет в мелкой, логической согласованности элементов, требующих локальной точности.

Контрпример: некоторые профессионально отретушированные фото или коллажи также могут иметь подобные артефакты. Поэтому важно сопоставлять признаки и учитывать контекст.

4. Используйте детекторы изображений как вспомогательный инструмент

Существуют веб‑сервисы и исследования, которые предлагают автоматическую проверку: они анализируют статистику изображения, сигнатуры компрессии и характерные паттерны генерации. Примеры подходов:

- анализ спектра частот;

- проверка метаданных файла (EXIF) на следы генерации или редактирования;

- сравнительный анализ против известных паттернов моделей.

Ограничения:

- инструменты дают вероятностную оценку, а не доказательство;

- они могут ошибаться, показывая ложноположительные и ложноотрицательные результаты;

- модели и сервисы быстро эволюционируют, и сигнатуры меняются.

Рекомендация: используйте детектор в связке с визуальным осмотром и проверкой метаданных.

Многошаговая методика проверки изображения (мини‑методология)

- Сначала проверьте метаинформацию: заголовок, описание, теги, комментарии и профиль автора.

- Осмотрите изображение в целом: есть ли водяной знак, необычные элементы на краях.

- Увеличьте мелкие области: лицо, руки, фон, текст.

- Проверьте EXIF-данные и дату создания файла (если доступны).

- Прогоните изображение через один или несколько детекторов изображений.

- Сопоставьте результаты и составьте вывод с уровнем уверенности (высокая/средняя/низкая).

SOP: пошаговый рабочий процесс для репортёров и модераторов

Шаг 1. Сохраните оригинал изображения и ссылку на пост. Шаг 2. Проверьте заголовок и описание на наличие упоминаний ИИ. Шаг 3. Откройте профиль автора и просмотрите похожие публикации. Шаг 4. Увеличьте изображение и проверьте лицо, руки, текст и мелкие детали. Шаг 5. Проверьте EXIF (если файл загружен напрямую). Шаг 6. Прогоните через как минимум два детектора изображений (разных разработчиков). Шаг 7. Сделайте скриншоты признаков и составьте отчёт с аргументацией. Шаг 8. Если требуется — свяжитесь с автором и запросите исходные файлы или подтверждение создания.

Критерии приёмки: если три из пяти методов (текст/теги, водяной знак, артефакты, EXIF, детектор) указывают на генерацию, считать изображение ИИ‑созданным.

Чек-листы по ролям

Для модератора (быстрая проверка):

- Есть ли упоминание ИИ в описании или тегах?

- Видим ли водяной знак платформы?

- Видны ли артефакты на лицах или руках?

- Подозрителен ли текст на изображении?

Для журналиста (повёрнутая проверка):

- Сохранил ли я оригинал и страницу публикации?

- Есть ли в EXIF сведения о редакторе или камере?

- Какая вероятность по детекторам?

- Можно ли получить комментарий автора?

Для юриста/комплаенса:

- Нарушает ли использование ИИ правила площадки?

- Была ли явная попытка выдать ИИ‑изображение за реальную фотографию?

- Нужна ли маркировка или правообладательское уведомление?

Дерево принятия решения

flowchart TD

A[Начало: у вас изображение] --> B{Есть ли указание об ИИ в метаданных, заголовке или тегах?}

B -- Да --> C[Отметить как ИИ или запросить подтверждение автора]

B -- Нет --> D[Проверить на визуальные артефакты]

D --> E{Найдено ли 2+ типичных артефакта?}

E -- Да --> F[Пройти через детектор изображения]

E -- Нет --> G[Сделать отметку: неявные признаки, продолжить наблюдение]

F --> H{Детектор выдаёт высокий риск?}

H -- Да --> C

H -- Нет --> G

C --> I[Заключение и документирование]

G --> IКогда методы не работают: примеры и предостережения

- Профессионально отретушированное фото может имитировать многие признаки ИИ (размытые участки, необычные композиции).

- Коллажи и цифровая живопись, созданные человеком, тоже могут иметь «мазки» и ассинхронные детали.

- Обработка изображений (компрессия, фильтры) может стереть следы генерации.

- Новые модели целенаправленно маскируют свои сигнатуры, что снижает эффективность детекторов.

Итого: если проверка даёт сомнительный или противоречивый результат, отмечайте это и указывайте уровень уверенности.

Тест-кейсы и критерии приёмки для инструментов детекции

- Тест: изображение с водяным знаком DALL-E. Ожидаемый результат: высокий риск генерации.

- Тест: реальная фотография высокого разрешения с метаданными камеры. Ожидаемый результат: низкий риск.

- Тест: коллаж, смешанный с AI-элементами. Ожидаемый результат: средний риск, требует ручной проверки.

Критерии приёмки для автоматического инструмента:

- точность при узнаваемых водяных знаках — >80% (ориентир, не утверждение);

- инструмент способен анализировать EXIF и возвращать список подозрительных признаков;

- доступен отчёт с указанием оснований для решения.

Этические и правовые соображения

- Прозрачность: авторы должны указывать использование ИИ, особенно в журналистике и рекламе.

- Достоверность: нельзя выдавать созданное ИИ изображение за фотодоказательство реального события.

- Лицензирование: проверьте условия использования модели и возможность коммерческого применения.

Примечание по приватности: при проверке EXIF вы работаете с метаданными, которые могут содержать персональные данные. Обрабатывайте их согласно локальным требованиям по защите данных.

Фактбокс с ключевыми пунктами

- Основные сигналы: метаданные и теги, водяные знаки, визуальные артефакты, автоматические детекторы.

- Ни один метод не даёт 100% ответа; лучше использовать комбинацию.

- ИИ и инструменты детекции постоянно эволюционируют.

Практические шаблоны и сниппеты

Короткий шаблон сообщения для запроса подтверждения у автора:

Здравствуйте! Я заметил(а) вашу работу — могу ли я уточнить, создавали ли вы изображение самостоятельно или использовали генератор ИИ? Это нужно для корректной атрибуции.

Чек-лист для быстрого скриншота (модератор):

- Заголовок/теги — упоминается ли ИИ?

- Видим ли водяной знак?

- Есть ли артефакты на лице/руках/тексте?

- Что показал детектор (указать ссылку и скрин)?

Глоссарий в одну строку

- GAN — генеративная состязательная сеть.

- Диффузионная модель — класс генеративных моделей, постепенно создающих изображение из шума.

- EXIF — метаданные изображения, включающие данные о камере и дате.

Короткое объявление для соцсетей (100–200 слов)

Ищете, как понять, создано ли изображение ИИ? Проверьте заголовок, теги и комментарии на упоминание ИИ, ищите водяные знаки и характерные искажения в лицах, руках и тексте. Прогоняйте изображения через детекторы как вспомогательный шаг. Комбинируя эти методы, вы сможете с высокой долей уверенности отличить сгенерированные изображения от реальных.

Короткое резюме

Определить изображение, созданное ИИ, можно, но это требует внимания и комплексного подхода. Проверяйте метаданные и публичную информацию, ищите водяные знаки и визуальные артефакты, используйте детекторы изображений как вспомогательный инструмент. При сомнениях документируйте все шаги и указывайте уровень уверенности в выводах.

Важно: технологии постоянно меняются — сохраняйте критическое мышление и обновляйте свои инструменты.

Заметки:

- Этот материал предназначен для обучения и принятия решений при модерации, журналистике и работе с визуальным контентом.

Похожие материалы

Несколько аккаунтов Skype: Multi Skype Launcher

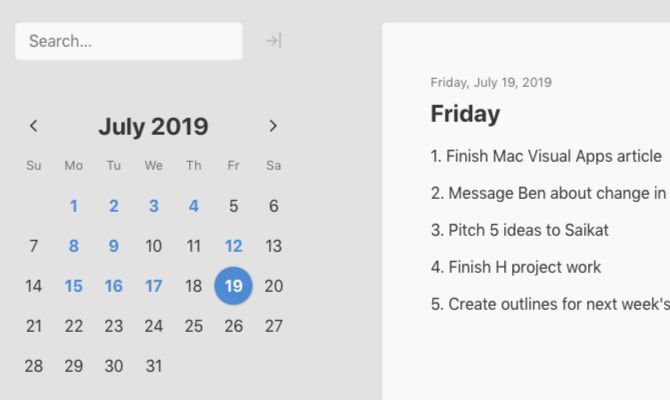

Журнал для работы: повысить продуктивность

Персональные звуки уведомлений на Android

Скачивание шоу Hulu для офлайн‑просмотра

Microsoft Start: персонализированная новостная лента