Как уменьшить галлюцинации у генеративного ИИ

Краткое содержание

- Чёткие и конкретные подсказки уменьшают вероятность ошибок в ответах. Избегайте общих запросов.

- Техника «согласно…» (grounding) помогает привязать вывод модели к заданному источнику или точке зрения.

- Правила и ограничения в подсказке формируют ожидаемый формат и стиль вывода.

- Многошаговое взаимодействие и назначение роли модели повышают осмысленность ответов.

Важно: ни одна техника не даёт 100% гарантии. Всегда проверяйте критичные данные у независимых источников.

1. Делайте подсказки максимально конкретными

Причина ошибок часто лежит в неоднозначности запроса. Чем яснее вы опишете задачу, тем проще модели выбрать релевантную стратегию генерации.

Практика:

- Не спрашивайте «Расскажи о собаках». Сформулируйте: «Опиши внешние признаки и характер золотистого ретривера для статьи на 300 слов».

- Укажите ожидаемый формат: буллеты, таблица, краткое резюме или подробная статья.

- Дайте целевую аудиторию: «для начинающих заводчиков» или «для врачей общей практики».

Преимущество: модель ограничена по стилю и объёму, и выдаёт менее расплывчатый текст.

2. Используйте привязку к источнику: «согласно…»

Опишите источник, от имени которого модель должна отвечать. Это помогает снизить изобретательность модели и сместить акцент на заданную базу знаний.

Примеры формулировок:

- «Дай определение термину X согласно Википедии».

- «Составь список рекомендаций по UX на основе публикаций в Google Scholar».

Ограничения:

- Если источник недоступен в обучающей выборке модели, привязка не делает ответ автоматически верным. Модель может симулировать стиль источника.

3. Задавайте правила и ограничения

Правила — это явные границы, которые нужно соблюсти. Они снижают вероятность неподходящего или нелогичного вывода.

Примеры:

- «Напиши сонет о любви: 14 строк, 10 слогов в строке».

- «Не упоминай медицинские советы; если нужен совет — предложи обратиться к специалисту».

Совет: комбинируйте ограничения по содержанию, стилю и длине, чтобы получить предсказуемый результат.

4. Разделяйте задачу на шаги (многошаговое уточнение)

Сложные вопросы вызывают ошибки, когда модель пытается решить всё сразу. Разбейте задачу на промежуточные шаги и запросите проверки промежуточных результатов.

Пример последовательности:

- Составь список возможных подходов.

- Для каждого подхода опиши преимущества и риски.

- На основе литературы отметь наиболее часто рекомендуемый метод.

Преимущество: вы получаете структуру рассуждения и возможность скорректировать промежуточные выводы.

5. Назначьте модель конкретной ролью

Формулировка «Представь, что ты — X» задаёт тон и поведение модели. Роль уточняет ожидания по глубине и стилю ответа.

Примеры ролей:

- «Исследователь» — больше ссылок и аргументов.

- «Техписатель» — ясный, краткий язык и шаги внедрения.

- «Маркетолог» — акцент на выгодах и CTA.

6. Добавляйте контекст и примеры

Контекст помогает модели понять домен и цель. Примеры показывают желаемый стиль и формат.

Что включить в контекст:

- Ключевые термины, категории, теги.

- Нужные ссылки или выдержки из источников.

- Пример желаемого вывода.

Пример промпта: «Напиши обзор товара X. Вот описание, отзывы и цена. Используй тон — нейтральный, длина — 200 слов».

Когда эти методы не помогают

Иногда даже идеальная подсказка не устраняет галлюцинации. Типичные причины:

- Модель не имеет доступа к актуальной или проверяемой базе знаний по теме.

- В обучающей выборке присутствовали противоречивые или ложные данные.

- Запрос требует фактической проверки (например, текущие цены, правовые статусы, клинические рекомендации).

Решения:

- Используйте внешнюю верификацию: базы данных, API или человек-проверяющий.

- Ограничьте использование модели для нерисковых задач, где погрешность допустима.

Альтернативные подходы

Если генеративная модель даёт ненадёжные ответы, рассмотрите:

- Модели поиска с явной ссылкой на источник (retrieval-augmented generation).

- Правила и шаблоны, генерируемые человеком, вместо свободного текста.

- Гибридные системы: модель генерирует черновик, человек его выверяет.

Мини-методика для уменьшения галлюцинаций (шаги для команды)

- Опишите цель и аудиторию. 2. Подготовьте источники и форматы вывода. 3. Напишите чёткий промпт с правилами. 4. Разбейте на шаги и запросите промежуточные проверки. 5. Прогоните ответ через верификатор (скрипт/API/человек). 6. Зафиксируйте результаты и шаблоны.

Чек-листы по ролям

Разработчик:

- Проверить, что модель использует нужную версию API.

- Добавить автоматические проверки фактов.

- Логировать промпты и ответы.

Контент-менеджер:

- Уточнить целевую аудиторию и стиль.

- Подготовить эталонные примеры.

- Финальная редактура и проверка фактов.

Юрист/Комплаенс:

- Проверить, нет ли в ответе запрещённых утверждений.

- Защитить персональные данные и соблюсти регуляции.

Шаблоны подсказок (templates)

- Фактическая заметка по источнику:

“Напиши краткую заметку (150–200 слов) на тему {тема} согласно {источник}. Укажи ключевые факты и дай 2 ссылки на разделы источника. Формат: заголовок, 3 буллета, вывод.”

- Разъяснение для непрофессионала:

“Объясни термин {термин} для читателя без технического образования. Используй аналогию и не более 3 пунктов с примерами.”

- Проверка фактов:

“Перечисли утверждения, которые требуют верификации, и предложи источники или API для проверки.”

Критерии приёмки

- Формат ответа соответствует шаблону.

- В тексте нет очевидных ошибок фактов (проверено человеком или API).

- Все утверждения, требующие подтверждения, снабжены ссылками или пометкой “нужна проверка”.

- Тон и сложность соответствуют целевой аудитории.

Ментальные модели и эвристики

- Локус контроля: чем более конкретна инструкция, тем больше контроля у пользователя.

- Разделяй и властвуй: разбей задачу на подзадачи, чтобы снизить когнитивную нагрузку модели.

- Минимальная достаточность: указывайте только те ограничения, которые действительно важны.

Диаграмма принятия решения

flowchart TD

A[Есть запрос к модели?] --> B{Запрос простой?}

B -- Да --> C[Оформить точный промпт]

B -- Нет --> D[Разбить на шаги]

D --> E[Назначить роль и источник]

C --> F[Попросить промежуточную проверку]

E --> F

F --> G{Требуется верификация?}

G -- Да --> H[Проверить через API/человека]

G -- Нет --> I[Финальная выдача]

H --> IГлоссарий

- Галлюцинация: утверждение модели, не подтверждённое фактами.

- Grounding: привязка ответа модели к конкретному источнику.

- Многошаговое уточнение: разбивка запроса на последовательные шаги.

Риски и способы смягчения

Риски:

- Некорректные факты приводят к ошибочным решениям.

- Утечка чувствительной информации при генерации.

- Ложное чувство доверия к автоматически сгенерированному контенту.

Митигаторы:

- Внедрить этап обязательной верификации для критичных задач.

- Ограничить доступ к модели и логировать все взаимодействия.

- Обучать пользователей распознавать признаки ненадёжного вывода.

Краткое резюме

Чёткие подсказки, привязка к источникам, правила и многошаговое взаимодействие существенно снижают вероятность галлюцинаций у генеративных моделей. Включайте этапы верификации и тестируйте шаблоны в реальных сценариях.

Примечание: применяйте эти рекомендации адаптивно в зависимости от риска и контекста задачи.

Похожие материалы

Несколько аккаунтов Skype: Multi Skype Launcher

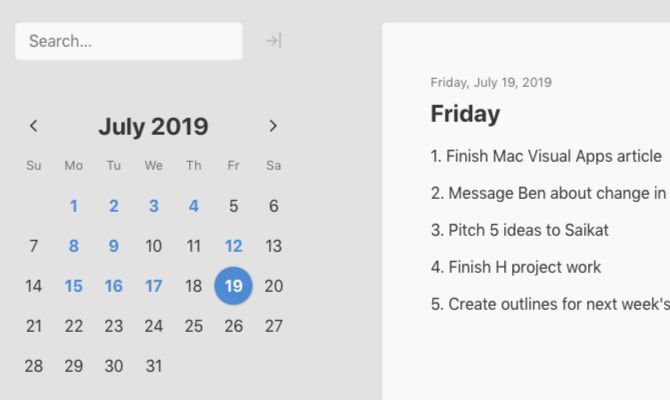

Журнал для работы: повысить продуктивность

Персональные звуки уведомлений на Android

Скачивание шоу Hulu для офлайн‑просмотра

Microsoft Start: персонализированная новостная лента