Как защитить свои изображения от генераторов искусства на базе ИИ

В то время как подражание стилям давно ушедших мастеров с помощью генераторов может показаться безобидным, использование работ живых художников вызывает серьёзные последствия: на рынке появляются подделки, размывается авторство, и авторы рискуют потерять доход. Люди ищут способы защитить свои изображения от включения в обучающие датасеты ИИ. Полностью надёжного решения пока нет, но существует ряд практических шагов, которые помогут снизить риск и подготовиться к будущим изменениям.

Почему это важно

Понимание угрозы помогает выбрать меры защиты. Основные риски:

- потеря дохода из‑за генерации копий в коммерческих целях;

- ухудшение репутации, если сгенерированные подделки принимают за оригиналы;

- невозможность контролировать, как и где используется ваша работа.

Важно смотреть на защиту как на процесс — сочетание юридических, технических и организационных мер.

Как генераторы ИИ получают ваши изображения

Генераторы учатся создавать изображения на примерах: им нужны массивы пар «изображение — подпись». Для обучения используются огромные коллекции картинок с подписями, собранные с веб‑сайтов. Некоторые известные модели были обучены на открытых наборах вроде LAION‑5B, который формируется с помощью веб‑скрейпинга.

Веб‑краулеры обходят страницы и собирают URL изображений и текстовые подписи — в результате получается некое подобие большой таблицы с метаданными. Если вы публиковали работы в интернете, велика вероятность, что они уже оказались в одном из таких датасетов, даже без вашего согласия.

1. Отказ от включения в обучающие датасеты (opt-out)

Преимущество: самый прямой способ заявить о нежелании быть источником данных для моделей. Недостатки: пока несовершенен и частично зависит от добросовестности третьих сторон.

Примеры и практические шаги:

- Проект Have I Been Trained? (Spawning) предоставляет поиск по LAION‑5B: можно проверить, есть ли ваши изображения в датасете. Сервис также поддерживает функцию opt‑out и передаёт списки LAION для удаления.

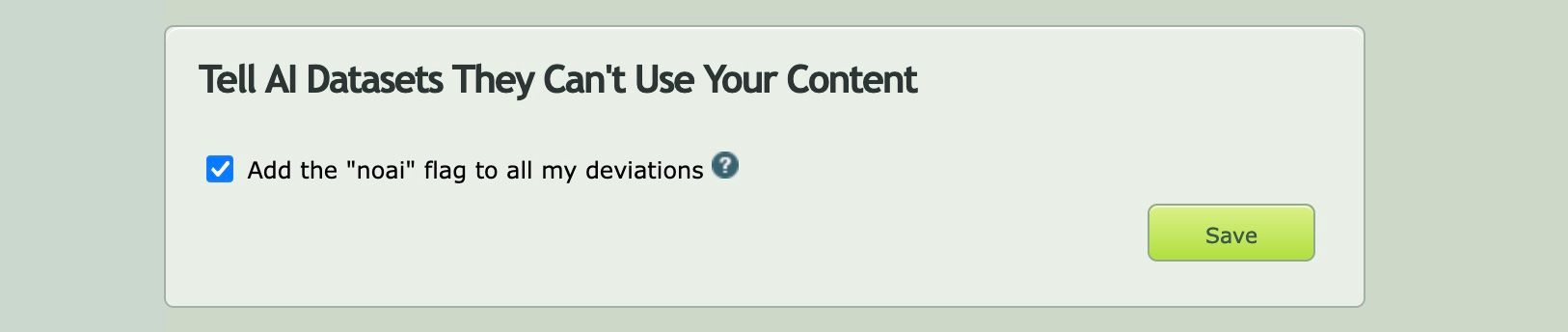

- DeviantArt ввёл метку “noai” для изображений: по умолчанию новые загрузки помечаются так, и использование для обучения, по условиям платформы, запрещено. Если модель обучилась с использованием изображений с сайта — это нарушение правил DeviantArt.

Ограничения:

- Нельзя массово выгружать десятки тысяч изображений в текущей версии многих инструментов opt‑out.

- Opt‑out применим только к тем датасетам и провайдерам, которые соглашаются его уважать. Многие компании не раскрывают источники своих данных.

Что делать прямо сейчас:

- Проверьте свои изображения по сервисам типа Have I Been Trained?.

- Если есть совпадения — воспользуйтесь формой opt‑out, как это позволяет сервис.

- На платформах, где есть флаг “noai” или аналог, всегда включайте его при загрузке.

Важное примечание: opt‑out — это юридическое и техническое заявление, но не абсолютная гарантия. Он работает лучше всего в сочетании с другими мерами.

2. Оформление авторских прав

Преимущество: юридическая защита, которая при наличии доказательств даёт возможность предъявлять претензии иски в суде. Недостаток: требуется время и зачастую расходы на судебные процессы.

Почему авторское право важно:

- Сбор изображений с веб‑сайтов для обучения ИИ уже оспаривается в суде. Классические примеры — иски авторов против компаний Stability AI и Midjourney, а также иск Getty Images против Stability AI за использование изображений без лицензии.

- Авторское право помогает доказать принадлежность работы и предъявить требование об удалении или возмещения ущерба.

Практические рекомендации:

- Зарегистрируйте ваши ключевые работы в национальных реестрах или используйте сервисы, которые фиксируют дату и содержание работы (логично для авторов, чей доход зависит от изображений).

- Ведите журнал публикаций: где и когда вы публиковали работу, под какими условиями (лицензия, платформа).

- Сохраняйте исходные файлы и метаданные (EXIF) — они могут стать доказательством авторства.

Где это пригодится:

- При подаче претензии платформам или провайдерам моделей.

- При судебных разбирательствах, когда нужно доказать, что изображение было использовано без разрешения.

3. Блокировка сканеров через Robots.txt

Преимущество: технический фильтр, который запрещает сканерам индексировать определённые части сайта. Недостатки: соблюдение зависит от роботов — злонамеренные скрейперы часто игнорируют Robots.txt.

Что такое Robots.txt в двух предложениях:

Robots.txt — это простой текстовый файл в корне сайта, который инструктирует веб‑краулеры, какие страницы и файлы можно индексировать. Это стандарт де‑факто для уважительных поисковых роботов и некоторых датасетов.

Пример базового Robots.txt:

User-agent: *

Disallow: /images/

Disallow: /uploads/Советы по применению:

- Поместите robots.txt в корень сайта (https://example.com/robots.txt).

- Закрывайте каталоги с изображениями или отдельные URL, которые не должны попадать в индекс.

- Помните: Robots.txt не шифрует контент и не защищает от прямых ссылок — он лишь просит роботов не сканировать.

Альтернативы и дополнения:

- Для сайтов с CMS используйте плагины, которые автоматически выставляют X‑Robots‑Tag или добавляют заголовки для отдельных файлов.

- Комбинируйте с ограничением доступа через аутентификацию (HTTP auth) для особо чувствительного контента.

Дополнительные меры и альтернативные подходы

Ни одна мера по отдельности не даёт полной гарантии. Рекомендуется комбинировать юридические и технические методы. Ниже — перечень практик, которые стоит рассмотреть.

- Визуальные водяные знаки и подписывание

- Преимущества: заметный способ пометить изображение; отпугивает частичное использование.

- Ограничения: водяные знаки можно удалить автоматическими инструментами; они портят эстетику изображения.

- Метаданные и подписывание (криптографический хеш)

- Вставляйте важные метаданные в EXIF/IPTC. Они не защищают от скрейпинга, но помогают доказать авторство.

- Криптографическая подпись или хеш изображения, зарегистрированный в доверенном хранилище (время‑штамп), облегчает доказательство происхождения.

- Цифровые методы «необучаемости» (adversarial perturbations)

- Исследования показывают, что небольшие, визуально незаметные искажения изображения могут сделать его бесполезным для обучения моделей.

- Ограничения: такие подходы пока находятся в стадии научных исследований и могут ломаться при изменениях в моделях.

- Ограничение разрешений и превью

- Публикуйте только уменьшенные превью или версия с пониженным качеством, если не хотите, чтобы оригинал попал в датасет.

- Для платного контента используйте защищённые галереи с авторизацией.

- Контроль доступа и лицензионные соглашения

- Чётко указывайте условия использования (лицензии) при публикации.

- Документируйте случаи нарушения и регулярно отправляйте DMCA‑запросы или аналоги для вашей юрисдикции.

Ментальные модели и эвристики при выборе меры защиты

- Многослойная защита > одиночная мера. Юридические, технические и организационные шаги усиливают друг друга.

- Защищайте наиболее ценные работы в первую очередь.

- Делайте выбор исходя из контекста: если ваша аудитория — коммерческие клиенты, акцентируйте авторские права и лицензирование; для широкой публики — метки noai и уменьшенные превью.

Мини‑методология: быстрый план действий за 30 дней

- Неделя 1: Проверьте свои основные работы с помощью поиска по LAION (Have I Been Trained?).

- Неделя 2: Для найденных совпадений подайте opt‑out и пометьте новые загрузки на платформах флагом noai.

- Неделя 3: Зарегистрируйте ключевые работы в реестре авторских прав или используйте сервисы для фиксации даты.

- Неделя 4: Настройте robots.txt и/или закройте галереи с высококачественными изображениями; рассмотрите водяные знаки.

Роль‑ориентированные контрольные списки

Художник / иллюстратор:

- Проверьте наличие в LAION и других публичных датасетах.

- Добавьте метку noai на платформах, где это поддерживается.

- Зарегистрируйте ключевые работы в реестре авторских прав.

- Публикуйте превью вместо оригиналов, где возможно.

Владелец сайта / куратор галереи:

- Разместите robots.txt и закройте каталоги с оригинальными файлами.

- Используйте заголовки X‑Robots‑Tag для файлы изображений.

- Настройте аутентификацию для приватных коллекций.

Разработчик / администратор платформы:

- Реализуйте флаг “noai”/метаданные при загрузке пользователей.

- Поддерживайте экспорт opt‑out списков для передачи в доверенные датасеты.

- Логируйте и отслеживайте обращения о нарушениях.

Критерии приёмки: как понять, что защита работает

- Вы удалили/закрыли оригиналы из общедоступных каталогов.

- Проведён opt‑out для всех найденных совпадений в поддерживаемых сервисах.

- Ключевые работы зарегистрированы и задокументированы.

- Есть процесс реагирования на нарушения (шаблоны писем, DMCA‑запросы).

Процесс реагирования при обнаружении использования ваших изображений (инцидентный план)

- Соберите доказательства: снимки экранов, URL, метаданные, хеши.

- Определите юрисдикцию и применимые законы/политику платформы.

- Отправьте запрос об удалении (DMCA или аналог) ответственному хосту/платформе.

- Если используемая модель принадлежит коммерческой компании — направьте официальную претензию и/или рассмотрите юридические шаги.

- Ведите журнал общения и сохраняйте все ответы.

Когда защитные меры терпят неудачу

- Если источник данных игнорирует Robots.txt и собирает картинки целенаправленно.

- Если модель обучается на очищенных от метаданных вариантах изображений или на их копиях, где удалены водяные знаки.

- Если датасет уже включил изображение до подачи opt‑out и использует внутреннее кэширование.

Факт‑бокс: ключевые ориентиры

- Большая часть крупных моделей обучалась на веб‑корпусах, которые формируют датасеты с помощью скрейпинга.

- Opt‑out полезен, но действует только при согласии владельцев датасета.

- Авторские права остаются одним из надёжных инструментов защиты в юридической плоскости.

Примеры альтернатив, когда основной подход неприменим

- Если публикация в сети необходима для продвижения, публикуйте только низкоразрешённые превью и храните оригиналы за аутентификацией.

- Для образовательных целей указывайте явные лицензии (Creative Commons с указанием условий).

Сравнение подходов — краткая шкала «Воздействие × Усилие»

- Авторское право: высокое воздействие, средние усилия (оформление/документация).

- Robots.txt: среднее воздействие, низкие усилия (поставить файл).

- Opt‑out в LAION/платформах: среднее воздействие, низкие усилия, но ограниченная охвата.

- Водяной знак: низкое/среднее воздействие, низкие усилия, влияет на эстетику.

- Adversarial perturbations: потенциально высокое воздействие, высокие усилия и риск несовместимости.

Небольшой справочник терминов

- Датасет: организованная коллекция данных для обучения моделей.

- Opt‑out: отказ от включения в наборы данных.

- Robots.txt: файл инструкций для веб‑краулеров.

- DMCA: американский механизм для подачи запросов об удалении контента по авторским правам.

- Adversarial perturbation: техническая модификация, затрудняющая обучение модели.

Диаграмма принятия решения

flowchart TD

A[У вас есть изображения в сети?] -->|Да| B{Хочется ли полностью скрыть оригиналы?}

A -->|Нет| Z[Публикация контролируемых превью]

B -->|Да| C[Закрыть доступ: аутентификация + robots.txt]

B -->|Нет| D{Нужна ли юридическая защита?}

D -->|Да| E[Оформить авторские права и документировать]

D -->|Нет| F[Использовать opt-out и пометки noai]

C --> G[Мониторинг и инцидентный план]

E --> G

F --> G

Z --> GЧасто задаваемые вопросы

Как быстро проверить, использовалась ли моя работа для обучения ИИ?

Проверьте сервисы вроде Have I Been Trained? и выполните поиск по ключевым изображениям и подписям. Это первый индикатор, но не исчерпывающий.

Что делать, если я обнаружил копии с водяным знаком или меткой моего сайта в сгенерированных изображениях?

Соберите доказательства (скриншоты, URL, метаданные). Отправьте запрос об удалении на платформу, где размещена сгенерированная картинка, и при необходимости — юридическую претензию.

Заключение

Защита изображений от использования в обучении ИИ — это сочетание технических мер, правовой фиксации и постоянного мониторинга. Opt‑out, авторское право и Robots.txt — три основные стратегии, которые вместе создают практический щит для ваших работ. Технологии и законы продолжают развиваться; сохраняйте внимательность, документируйте свои творения и используйте комбинированный подход.

Краткое напоминание: начните с проверки своих работ в датасетах, добавьте метки noai на платформах, зарегистрируйте ключевые работы и закройте доступ к оригиналам там, где это возможно. Это даст вам разумный уровень защиты до появления более совершенных решений.

Если хотите, я могу подготовить: 1) шаблон письма для подачи opt‑out/DMCA; 2) пример robots.txt под ваш сайт; 3) чек‑лист для художников в формате PDF.

Похожие материалы

Несколько аккаунтов Skype: Multi Skype Launcher

Журнал для работы: повысить продуктивность

Персональные звуки уведомлений на Android

Скачивание шоу Hulu для офлайн‑просмотра

Microsoft Start: персонализированная новостная лента