Как массово скачивать файлы из открытых директорий с помощью JDownloader

Введение

Мы часто сталкиваемся с ситуациями, когда нужно скачать сотни или тысячи файлов из открытой директории или страницы. Ручное сохранение займёт много времени. JDownloader — бесплатный менеджер загрузок, который умеет проверять ссылки, группировать и скачивать файлы пакетно. В этой инструкции я покажу надёжный рабочий процесс с использованием простого веб-инструмента для извлечения ссылок и JDownloader для массовой загрузки.

Что понадобится

- JDownloader (скачать с официального сайта JDownloader). Убедитесь, что версия актуальна.

- Браузер и доступ к открытой директории или странице с файлами.

- Веб-инструмент «Link Extractor» (Webmaster Toolkit) или любой аналог, который извлекает HREF/IMG.

- Простой текстовый редактор (Блокнот/Notepad или другой) для поиска и замены.

Краткий обзор процесса

- Найти открытую директорию или страницу с файлами. Например, /r/opendirectories на Reddit часто содержит такие ссылки.

- Извлечь все HREF-ссылки с помощью Link Extractor.

- Очистить результат (удалить ссылку родительской директории и заменить пробелы на %20).

- Вставить список в JDownloader — Linkgrabber проверит ссылки.

- Запустить загрузку и контролировать прогресс во вкладке Downloads.

Пошаговая инструкция

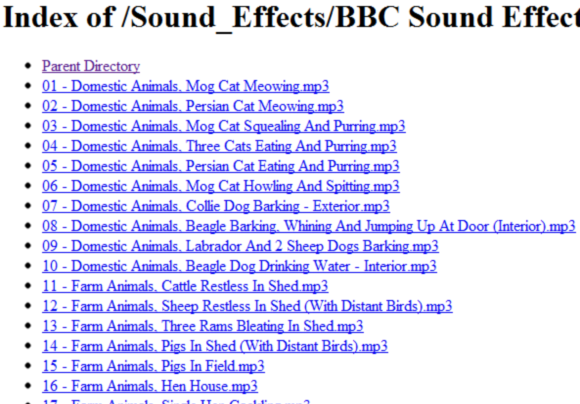

1) Найдите открытый каталог

Откройте страницу с открытой директорией. Это может быть ссылка, опубликованная на форуме, в архиве или прямо на сайте. Часто это простая индексная страница со списком файлов.

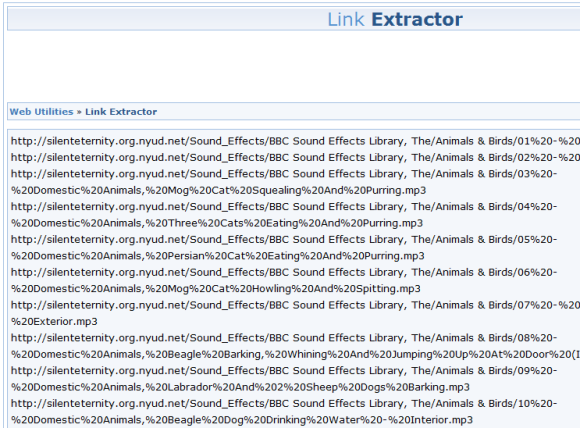

2) Извлеките ссылки (HREF)

Перейдите на Link Extractor (Webmaster Toolkit). Вставьте URL открытой директории и выберите извлечение HREF (не IMG), если хотите файлы любого типа. Нажмите «Extract» — инструмент выдаст список всех ссылок.

Совет: если собираете только изображения с веб-страницы, выберите IMG.

3) Скопируйте результаты и удалите родительскую ссылку

Скопируйте все результаты, но исключите последнюю строку — ссылка на родительскую директорию (“../“ или «Parent Directory»). Это обычно один уровень выше и не содержит нужных файлов.

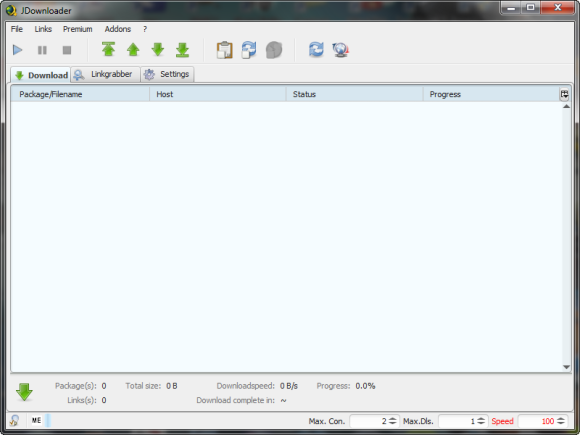

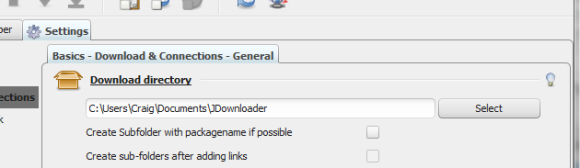

4) Откройте JDownloader и настройте папку сохранения

Установите и запустите JDownloader. Перейдите в Настройки — выберите папку для загрузки.

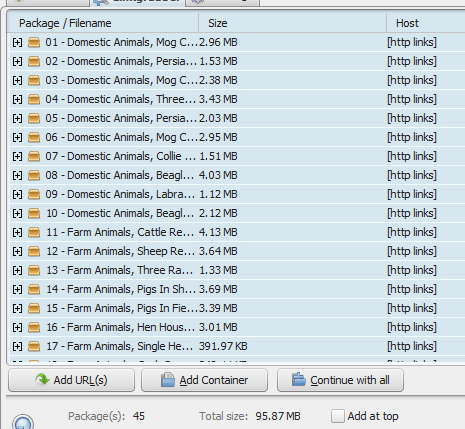

Затем откройте вкладку Linkgrabber. Linkgrabber проверяет ссылки на доступность и собирает метаданные перед загрузкой.

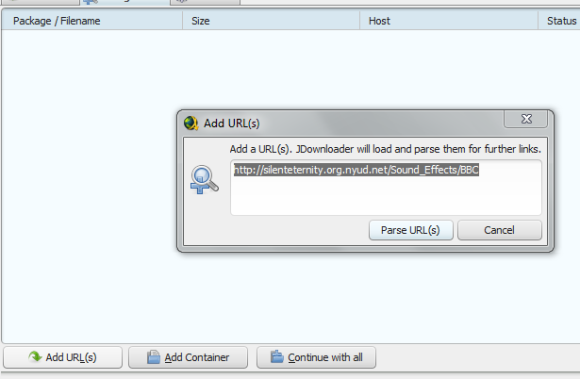

Нажмите «Add URL(s)» (Добавить URL). JDownloader попытается считать ссылки из буфера обмена.

5) Исправляем пробелы в URL

Инструмент иногда воспринимает ссылки с пробелами. В URL пробелы недопустимы — они должны быть закодированы как %20. Выполните простую замену:

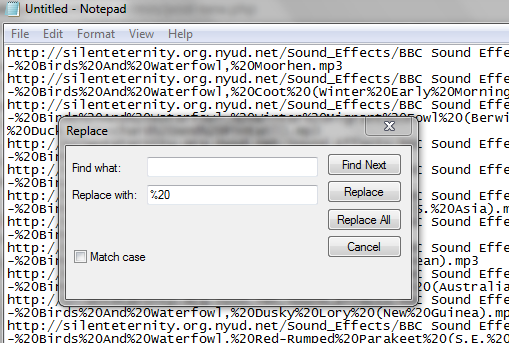

- Вставьте список ссылок в Блокнот.

- В меню «Правка» выберите «Заменить…».

- В поле «Найти» введите пробел. В поле «Заменить на» введите %20.

- Нажмите «Заменить всё».

Примечание: для большинства сайтов пробелов нет. Этот шаг нужен редко, но он решает распространённую проблему.

6) Вставьте исправленные ссылки в JDownloader

Удалите временную строку в диалоге JDownloader и вставьте исправленный список. Linkgrabber автоматически проверит каждый URL и покажет общий размер файлов.

Проверьте статус ссылок: доступен ли файл, есть ли редиректы, корректные ли имена.

7) Запустите загрузку

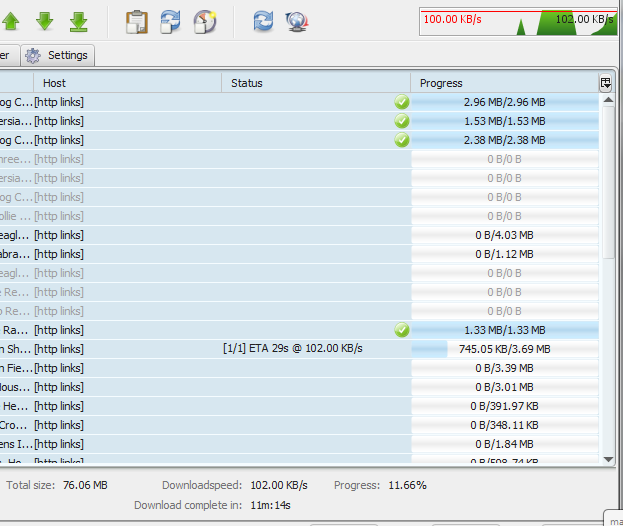

Нажмите кнопку «Play» в JDownloader. Вы перейдёте во вкладку Downloads, где сможете отслеживать прогресс, приостанавливать и возобновлять загрузки.

Критерии приёмки

- JDownloader импортировал все (ожидаемые) ссылки из списка.

- Linkgrabber показал корректный суммарный размер и несущественное количество 404/ошибок.

- Файлы загрузились в выбранную папку и открываются локально.

- Имена файлов и расширения сохранены корректно.

Когда этот метод не сработает

- Доступ к директории закрыт (требуется авторизация). В этом случае нужно логиниться или использовать API/скрипты с учётом авторизации.

- Ссылки динамически генерируются через JavaScript. Link Extractor может не увидеть их — используйте парсер страниц или расширение браузера для сбора ссылок из рендеренной страницы.

- Скорость или лимиты сервера: сайт может ограничивать количество одновременных загрузок или блокировать IP при массовых запросах.

- Лицензии и авторские права: закрытые или защищённые файлы нельзя скачивать без разрешения.

Альтернативные подходы

- Расширения браузера: DownThemAll (существует как расширение) или аналогичные тулзы для массового сохранения ссылок прямо из браузера.

- Другие загрузчики: Free Download Manager, Internet Download Manager — имеют похожие функции управления очередями.

- Скрипты на Python: для продвинутых пользователей — написать парсер, который скачивает файлы по списку ссылок (requests + aiohttp для асинхронности).

- Wget/cURL: командная строка подходит для автоматизации и работы на серверах.

Рекомендации по безопасности и приватности

- Проверьте лицензию и права на материалы. Скачивание защищённого контента без разрешения незаконно.

- Не вставляйте ссылки с неизвестных источников в автозагрузку без проверки: они могут указывать на вредоносные файлы.

- При массовых загрузках соблюдайте polite crawling: не перегружайте чужие серверы — ставьте ограничение параллельных потоков и делайте паузы.

- Если требуется авторизация, используйте безопасные токены или сессии; не храните пароли в открытом виде.

Роль‑ориентированные чеклисты

Для новичка

- Установить JDownloader и выбрать папку загрузки.

- Скопировать ссылки из Link Extractor.

- Убедиться, что список не содержит родительской директории.

- Проверить несколько ссылок вручную в браузере.

- Вставить и запустить загрузку.

Для продвинутого пользователя

- Настроить ограничение параллельных загрузок и скорость в настройках JDownloader.

- Использовать прокси/ротацию IP при больших объёмах.

- Автоматизировать извлечение ссылок скриптом при регулярных задачах.

- Логировать ошибки и перезапускать неудачные загрузки.

Мини‑методология и эвристики

- Всегда сначала проверяйте несколько файлов вручную. Если первые 5 — корректны, вероятность успеха для остальных высока.

- Исключайте URL, которые ведут на каталоги, а не на файлы (.html/.php без параметров обычно — страница).

- Префикс “../“ обычно указывает на родительскую директорию — удаляйте такие строки.

Краткий анонс (100–200 слов)

Если вам нужно быстро и надёжно скачать сотни файлов из открытой директории, комбинируйте простой веб‑парсер ссылок и JDownloader. Сначала извлеките HREF‑ссылки с помощью Link Extractor, исправьте возможные пробелы (замените на %20), затем вставьте список в Linkgrabber JDownloader. Linkgrabber проверит доступность и подсчитает суммарный размер, после чего вы сможете запустить массовую загрузку и отслеживать прогресс во вкладке “Downloads”. Это работает для изображений, звуковых эффектов и любых публичных файлов. Метод экономит часы ручной работы и даёт гибкие настройки скорости, параллельных загрузок и папок сохранения. Соблюдайте правила сайта и авторские права, не перегружайте серверы и проверяйте ссылки перед массовой загрузкой.

Глоссарий (одно предложение)

- Linkgrabber — модуль JDownloader для проверки и подготовки ссылок к загрузке.

- HREF — HTML‑атрибут для ссылки на ресурс.

- IMG — HTML‑элемент для изображений; используется при сборе картинок.

- %20 — URL‑кодировка пробела.

Критерии тестирования (примеры)

- Тест 1: 10 ссылок разных типов — все скачиваются корректно в течение часа.

- Тест 2: В списке есть 2 ссылки 404 — JDownloader помечает их как недоступные и не тратит на них трафик.

- Тест 3: Ссылки с пробелами — после замены на %20 все файлы скачиваются.

Заключение

JDownloader в паре с простым извлечением ссылок — быстрый и надёжный инструмент для массового скачивания из открытых директорий. Он экономит время и даёт контроль над процессом. Помните об этике скачивания и технических ограничениях серверов. Если нужна помощь с конкретной директорией или возникли ошибки — опишите проблему и я помогу с диагностикой.

Важно: если директория требует входа или ссылки генерируются динамически, опишите конкретный случай — я подскажу дальнейшие шаги.

Похожие материалы

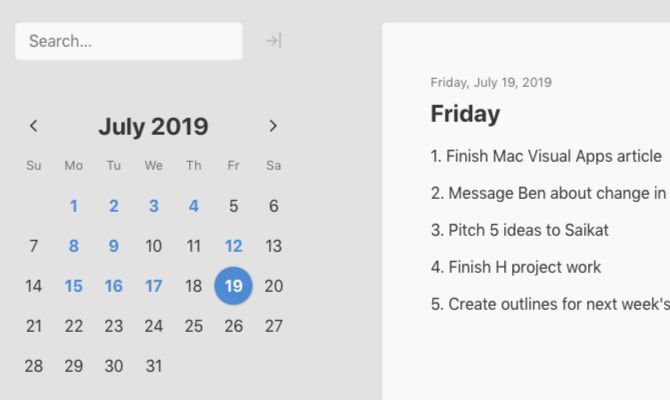

Несколько аккаунтов Skype: Multi Skype Launcher

Журнал для работы: повысить продуктивность

Персональные звуки уведомлений на Android

Скачивание шоу Hulu для офлайн‑просмотра

Microsoft Start: персонализированная новостная лента