Opera One R2: AI‑Ready‑PC‑Test verwenden

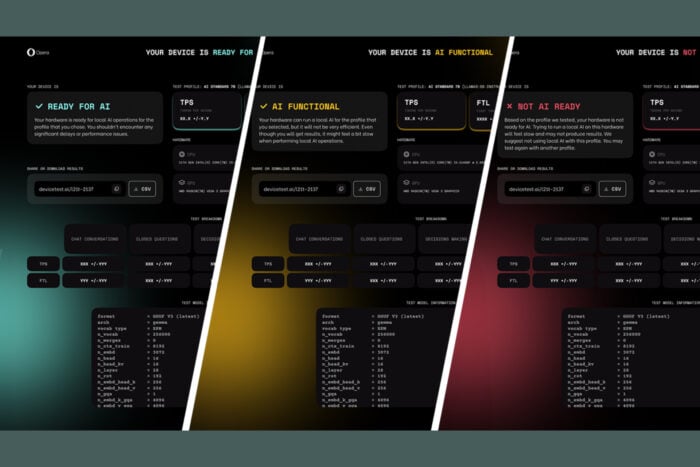

Copilot+ PC und AI-bereit PC sind zwei Begriffe, die derzeit vielen Menschen im Kopf herumschwirren. Wir alle wissen, dass Sie einen NPU-Coprozessor benötigen, um KI-Aufgaben lokal auszuführen. Andernfalls können Sie Online-Bots wie GchatGPT, Copilot und Gemini verwenden. Mit der Einführung des Opera One R2 Browsers können Sie jedoch jetzt genau herausfinden, ob Ihr PC AI-bereit ist oder nicht, indem Sie den AI-bereit PC-Test verwenden.

Copilot+ PC und AI-bereit PC sind zwei Begriffe, die derzeit vielen Menschen im Kopf herumschwirren. Wir alle wissen, dass Sie einen NPU-Coprozessor benötigen, um KI-Aufgaben lokal auszuführen. Andernfalls können Sie Online-Bots wie GchatGPT, Copilot und Gemini verwenden. Mit der Einführung des Opera One R2 Browsers können Sie jedoch jetzt genau herausfinden, ob Ihr PC AI-bereit ist oder nicht, indem Sie den AI-bereit PC-Test verwenden.

Wie benutze ich Opera, um zu überprüfen, ob mein PC AI-bereit ist?

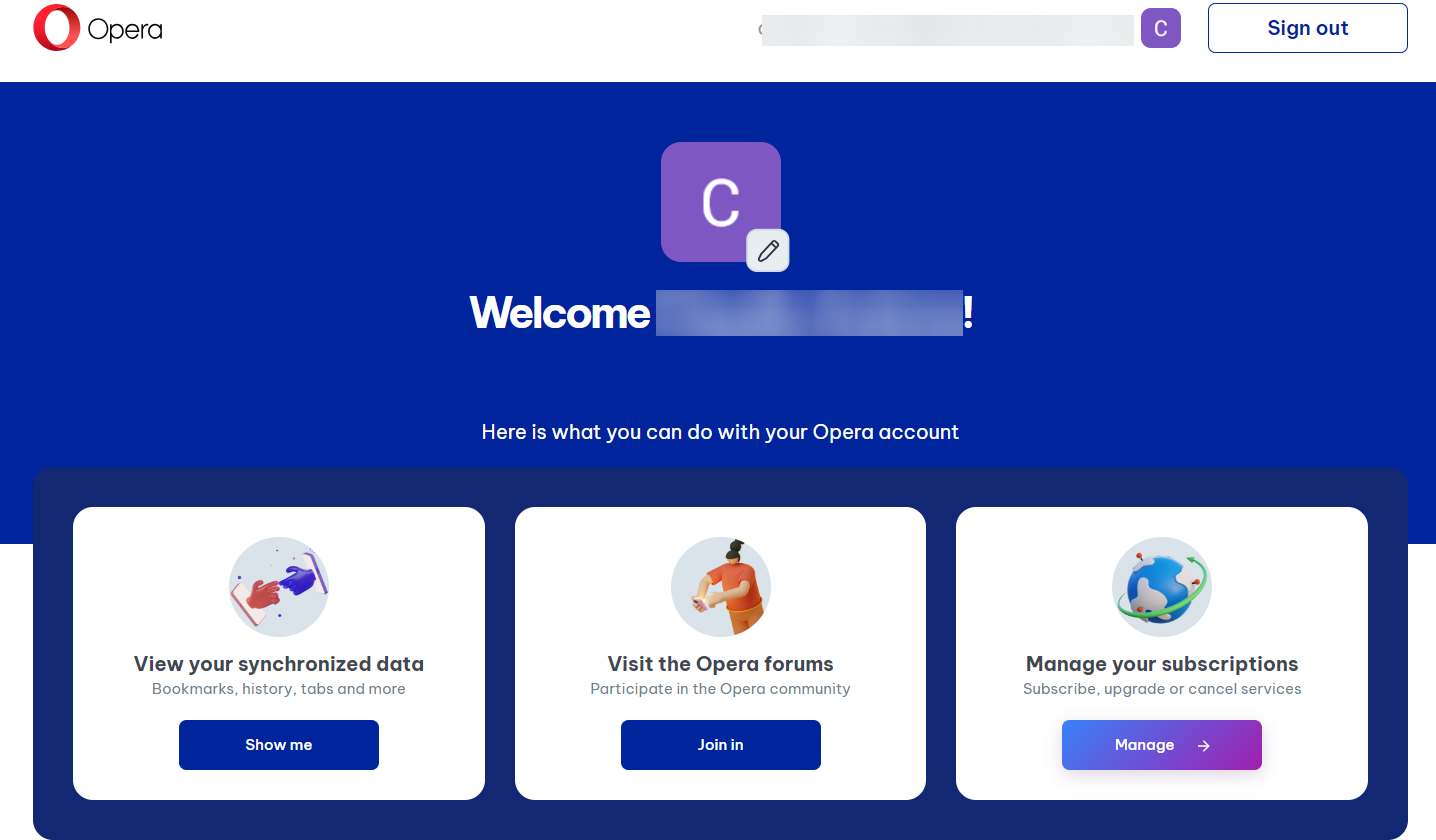

- Starten Sie Opera One R2 und melden Sie sich mit einem E-Mail-Konto, Google-Konto, Apple-ID usw. an. Wenn Sie sich nicht anmelden, können Sie Aria AI nicht verwenden.

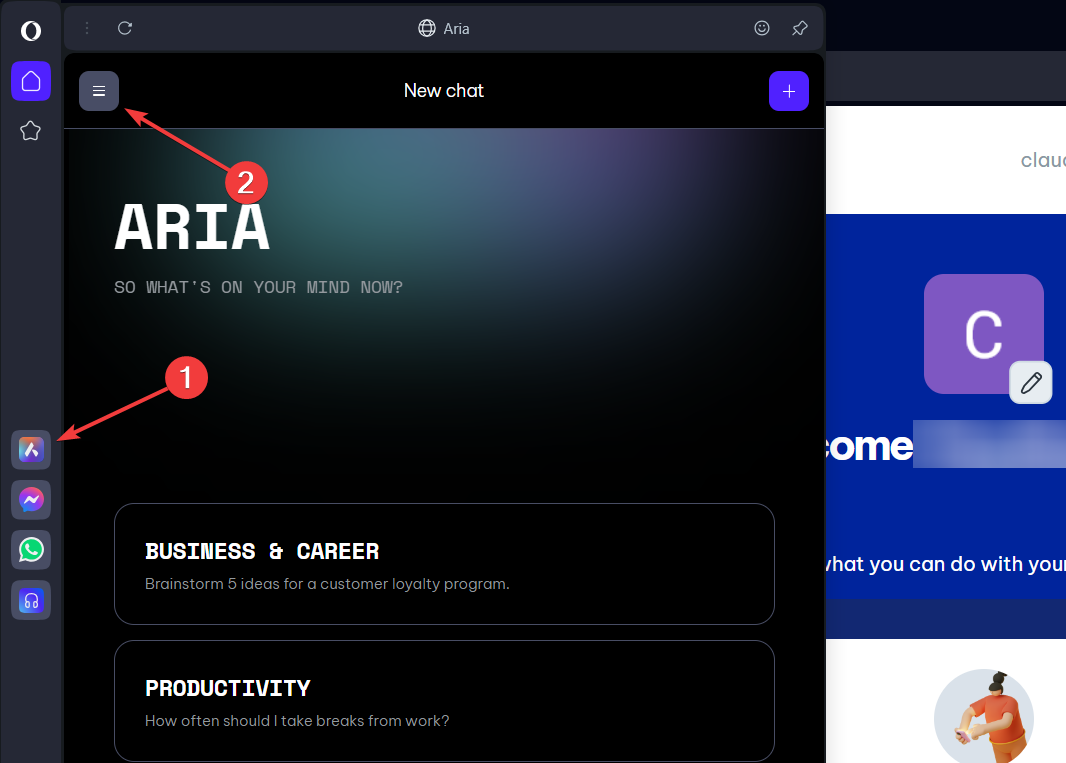

- Klicken Sie auf das Aria-Symbol und dann auf die Menü-Schaltfläche in der oberen linken Ecke.

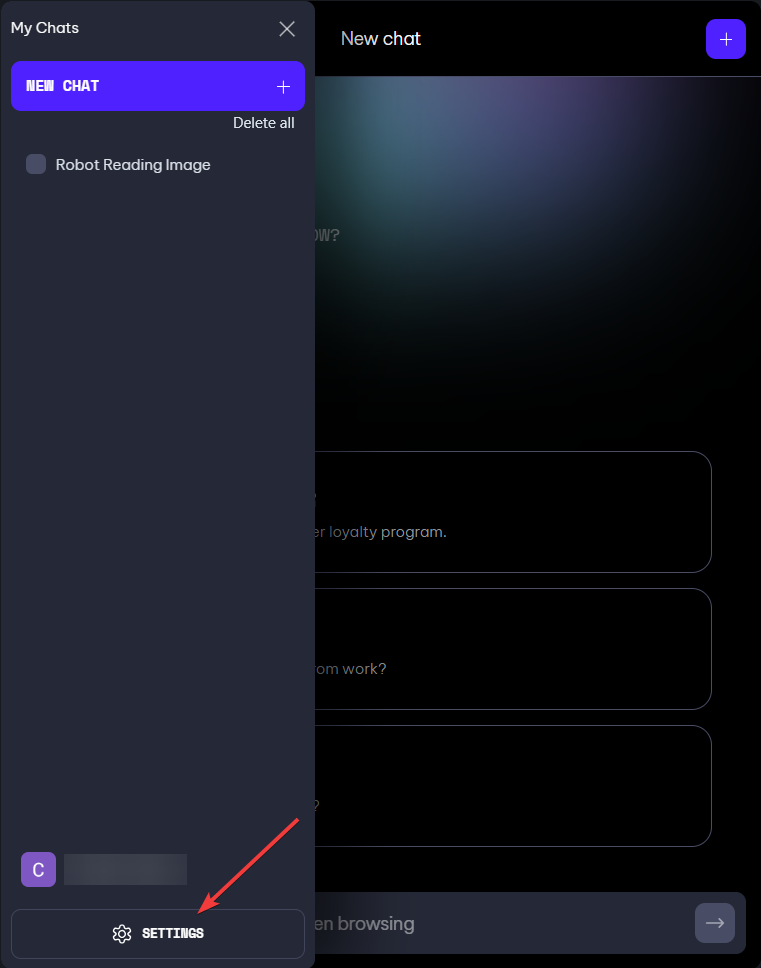

- Wählen Sie nun Einstellungen am unteren Rand des Fensters.

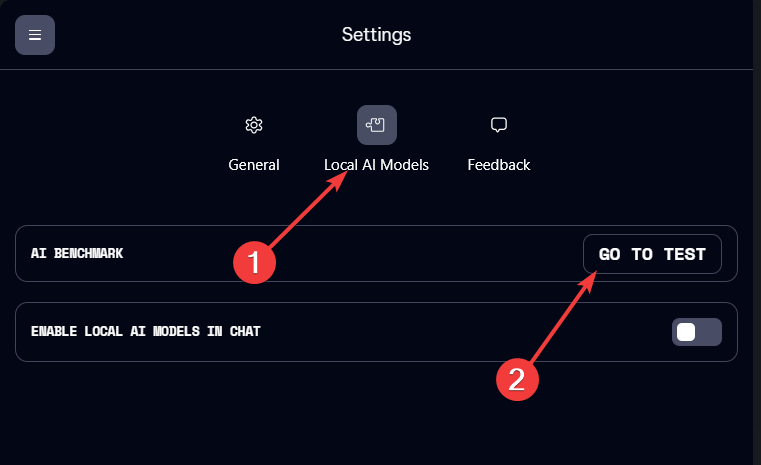

- Klicken Sie hier auf Lokale KI-Modelle und drücken Sie die Gehe zu Test-Schaltfläche unter KI-Benchmark.

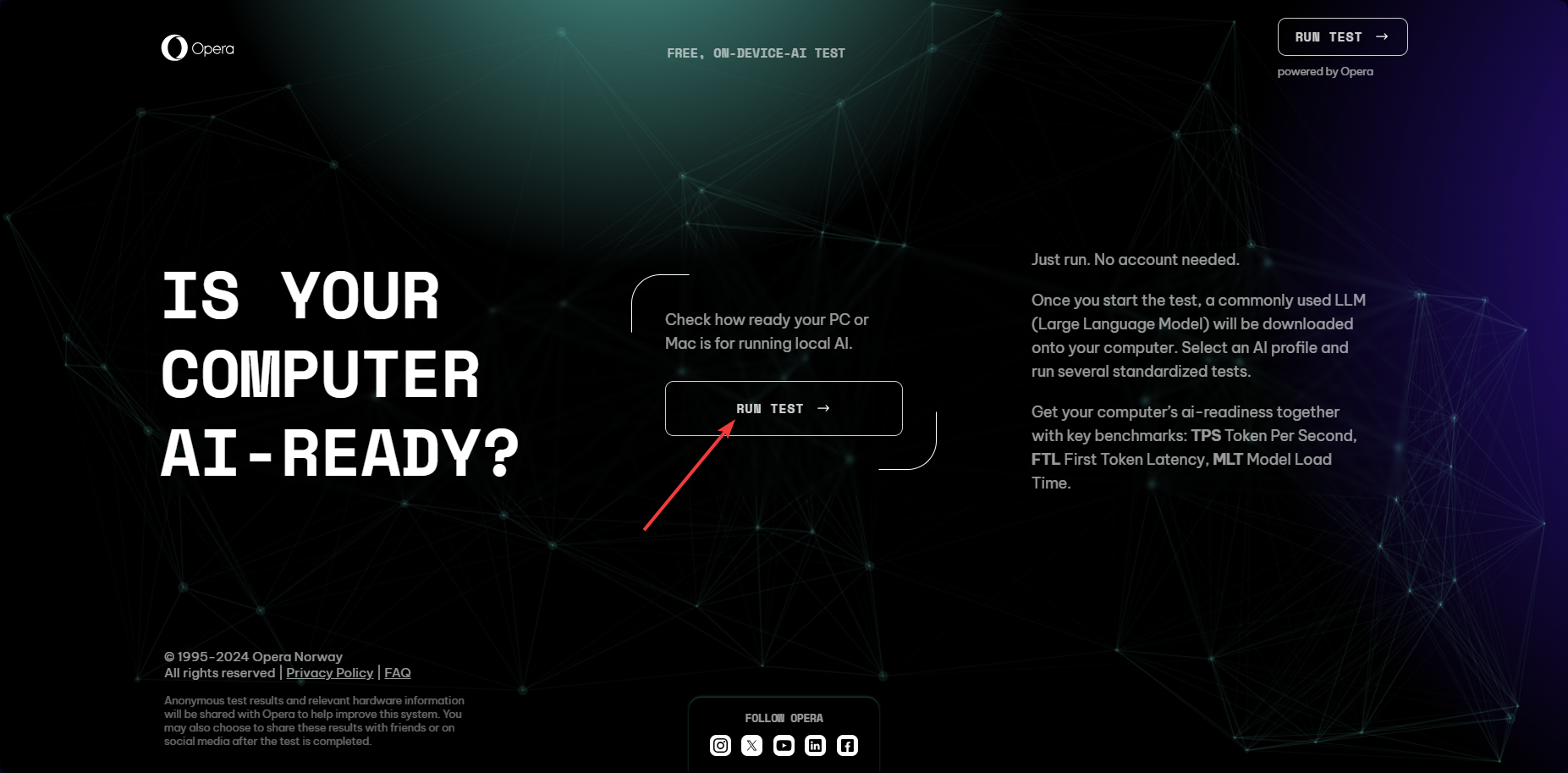

- Sie werden zu einem neuen Tab weitergeleitet, in dem Sie auf Test ausführen klicken können, um zu beginnen.

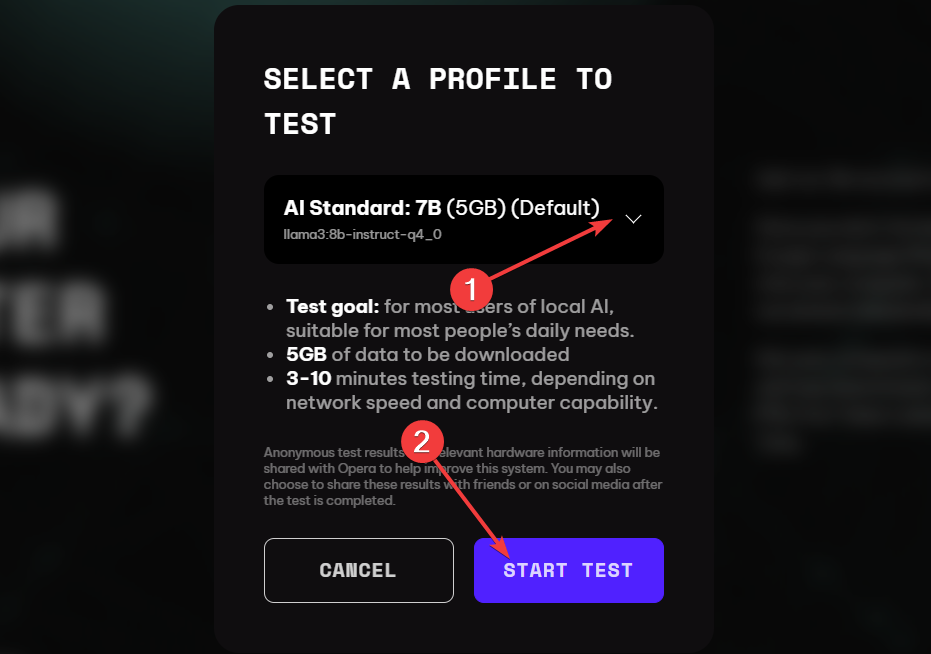

- Wählen Sie schließlich das KI-Profil aus, das Sie testen möchten, und klicken Sie auf Test starten.

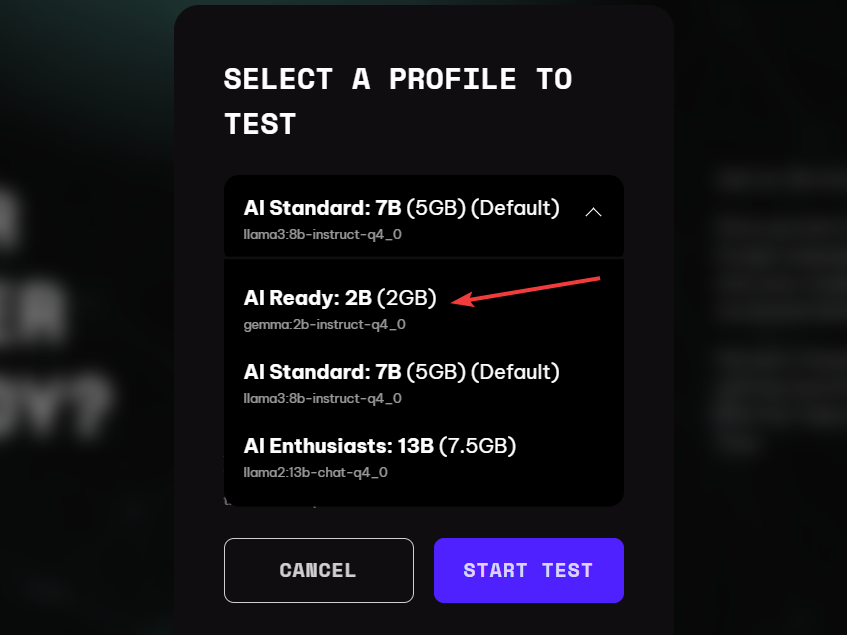

- Es sei denn, Sie haben einen der neuesten Copilot+ PCs gekauft, empfehlen wir, zuerst mit dem AI Ready-Profil zu beginnen.

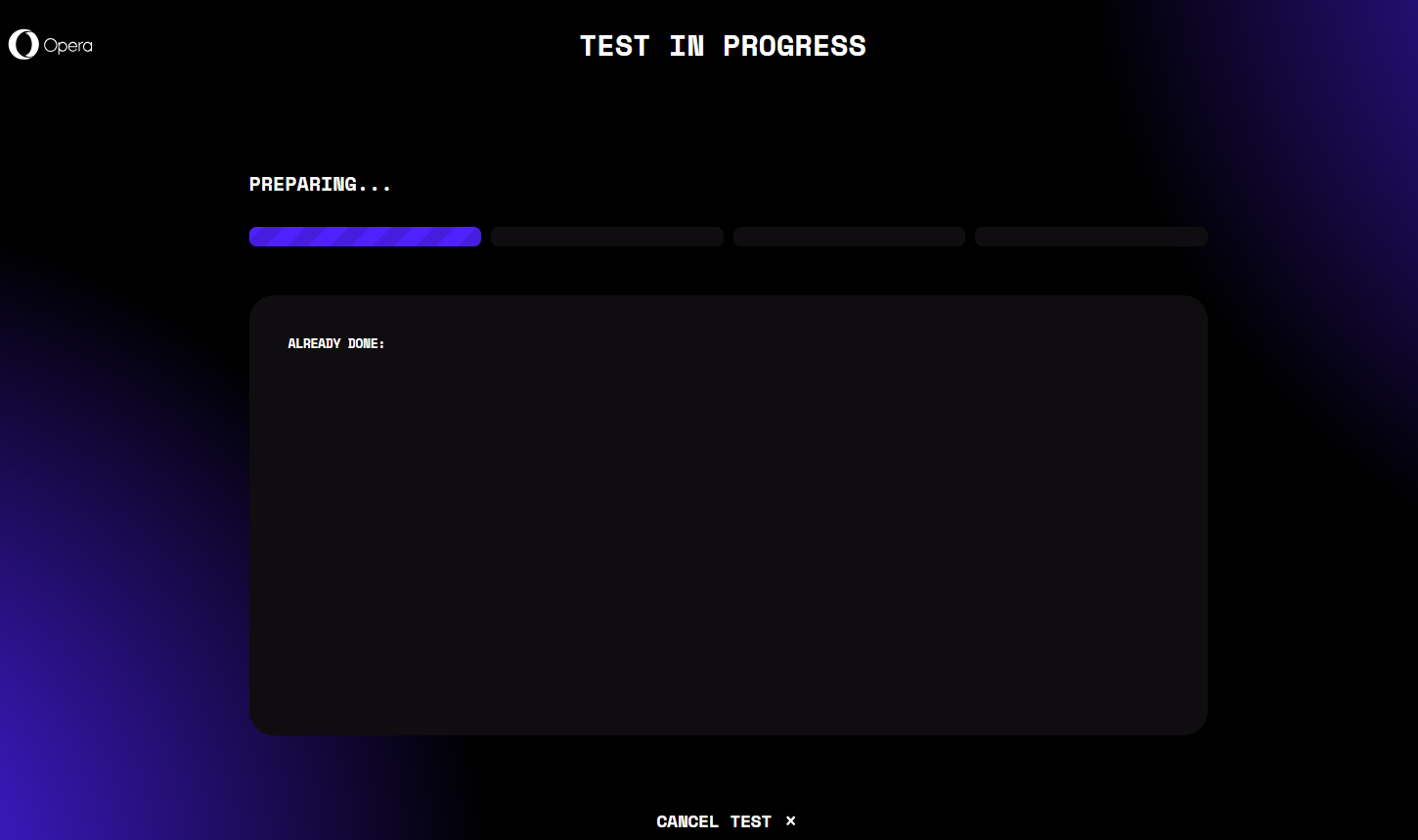

- Sobald Sie auf die blaue Start-Schaltfläche klicken, führt der Browser den KI-Test für Ihren PC durch.

Die Webanwendung lädt ein LLM herunter und führt mehrere Tests durch, um die KI-Fähigkeiten Ihres PCs zu bewerten.

Für diese Tests benötigen Sie zwischen 2 GB und 7,5 GB freien Speicherplatz auf Ihrem Laufwerk und eine Grafikkarte, die Softwarebeschleunigung unterstützt. Sie erhalten einen vollständigen Bericht, ob Ihr PC AI-bereit ist oder nicht.

Opera One R2 bringt auch das Split-Screen-Tabbing mit sich. Klicken Sie auf den hervorgehobenen Link, um zu lesen, wie Sie diese Funktion nutzen können.

Haben Sie den AI-bereit PC-Test von Opera durchgeführt? Erzählen Sie uns in den Kommentaren unten alles darüber.

Ähnliche Materialien

Podman auf Debian 11 installieren und nutzen

Apt-Pinning: Kurze Einführung für Debian

FSR 4 in jedem Spiel mit OptiScaler

DansGuardian + Squid (NTLM) auf Debian Etch installieren

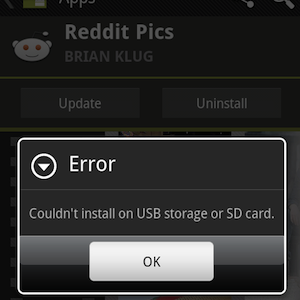

App-Installationsfehler auf SD-Karte (Error -18) beheben