なぜ視覚検索が重要か

街を歩いていて見かけた虫や果物、看板をすぐに知りたいとき、言葉で正確に説明するのは難しいことが多いです。モバイル端末の性能向上と普及により、多くの人が移動中にスマートフォンで検索します。小さなキーボードで打つのが面倒な場合、カメラで撮って検索する視覚検索は即時性と利便性のニーズに応えます。

視覚検索の主な利点:

- 文字で表現しにくい対象でも認識できる

- 移動中や時間がない状況での即時解答に向く

- 検索体験をより直感的にする

重要な定義: 視覚検索 — 写真やカメラ映像を入力として、画像認識と機械学習を使い対象を特定・分類し関連情報を返す検索方法。

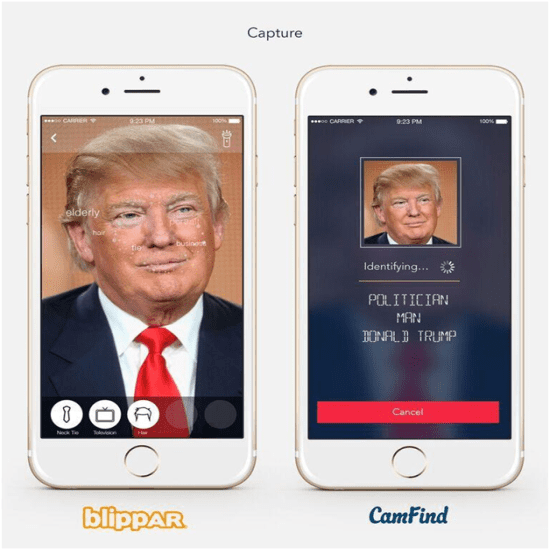

CamFind と Blippar の比較(要約)

ある比較動画とそれに基づく再現テストでは、同じ写真(共和党大統領候補の写真)を用いてどちらが人物を特定できるかを検証しました。結果は次の通りです。

- CamFind: 被写体がドナルド・トランプであることを正しく識別し、関連するニュース、画像、世論調査、メディアやショッピング結果へのリンクまで提示した。

- Blippar: 写真の一般的な情報(例:「政治家」「政権」など)や定義、さらにはノンシーケンシャルなリンク(ネクタイの結び方など)を提示したが、人物名として特定はしなかった。

この簡易比較をオフィスの身近な物で再現したところ、CamFind の方が全体的に速く・精度高く・使いやすいという印象が得られました。Blippar は画像の特徴を解析しようとしている様子は見えるものの、多くの場合で正確な識別や実用的なリンク提示に至りませんでした。

どのようにテストしたか(ミニ・メソドロジー)

- 同一の静止画を両アプリで連続検索

- 出力された「識別ラベル」の有無と正確性を評価

- 提示されたリンクや関連結果の有用性を主観評価(ニュース、関連画像、ショッピング等)

- レスポンスタイムと操作のしやすさを確認

テストは限定的で再現性の検討が必要ですが、日常的な使用感としての比較は有益です。

視覚検索がうまくいかないケース(反例と限界)

- 部分的に遮られた被写体や低解像度の写真では誤認識が増える。

- 文脈が重要な対象(例:歴史的な出来事を示す写真)では単純な物体認識だけでは情報が不足する。

- 類似物(同種の花や虫)を種レベルで識別するのは依然として難しい。

- 有名人の顔でも角度や表情、照明で認識率が下がることがある。

重要: 視覚検索は万能ではなく、補助ツールとしてテキスト検索や専門家確認と組み合わせるのが安全です。

代替アプローチと比較対象

視覚検索アプリは複数あります。代表的な代替例:

- Google レンズ: 広範なデータベースと検索エンジン連携による堅牢性

- Pinterest Lens: ビジュアル発見に強み。類似画像やアイデア発見が得意

- 専門アプリ(植物識別、昆虫識別など): ドメイン特化で高精度

選び方のヒューリスティック: 目的が「情報確認」なら汎用(Google Lens/CamFind)、目的が「発見やインスピレーション」なら Pinterest、目的が「学術的な識別」なら専門アプリ。

実務者向けチェックリスト(役割別)

ユーザー(一般):

- 写真はできるだけ近接・中央に収める

- 複数アングルで撮って確認する

- 結果は複数ソースで裏取りする

モバイル開発者:

- 既存API(Google Vision/Apple Vision)との比較テストを行う

- オフラインでのフォールバックを考慮する(低帯域時)

- プライバシー(カメラ画像の送信先・保持期間)を明示する

プロダクトマネージャー:

- 成功定義(識別精度・レスポンス時間・ユーザー満足度)を設定する

- ドメインごとの評価セットを用意してA/Bで比較する

受け入れ基準

視覚検索機能を製品に組み込む場合の基本的な受け入れ基準の例:

- 正答率: 定義された評価セット(100枚)でカテゴリ分類のトップ1精度が目標値を満たすこと(目標値はプロジェクトごとに設定)

- レイテンシ: 平均レスポンスがユーザー許容内であること(例: 3秒未満、ただし環境依存)

- プライバシー: 画像取り扱いの説明とオプトイン/オプトアウトが実装されていること

- フォールバック: ネットワーク障害時の挙動が定義されていること

実際の運用で便利なプレイブック(短い手順)

- ユーザーが対象を撮影する

- 端末で軽量な前処理(トリミング、回転補正)を行う

- サーバーまたは端末上で推論を実行

- 結果をカテゴリ・関連リンク・追加アクション(保存・共有)で提示

- ユーザーのフィードバックを収集してモデル改善ループを回す

心得となるメンタルモデル(見分け方のコツ)

- 「近接で識別」:細部が見えるほど識別精度は上がる。

- 「文脈で補う」:写真だけで迷う場合は周囲の要素(服装、背景)を手掛かりにする。

- 「複数角度」:横・正面・拡大など複数の写真で確度を上げる。

発展段階(成熟度の目安)

- レベル1(基礎): 物体カテゴリの大分類が可能(例: 人、車、植物)。

- レベル2(実用): 一般的な固有名詞や有名人・製品が識別可能。

- レベル3(高精度): 種レベルの識別や文脈理解を伴う推薦が可能。

ほとんどの消費者向けアプリは現在レベル1〜2の境界にあります。

セキュリティとプライバシーの注意点

- カメラ画像には個人情報が含まれる可能性があるため、画像送信先と保存期間を明示する。

- サードパーティAPIを使う場合はデータ処理契約(DPA)を確認する。

- 法的制約(顔認識に関する地域規制)に留意する。

短い決定フロー(どのアプリを試すべきか)

flowchart TD

A[目的は何か?] --> B{情報確認か発見か}

B -->|情報確認| C[汎用的な視覚検索: Google Lens / CamFind]

B -->|発見| D[Pinterest Lens]

C --> E{専門性が必要か}

E -->|はい| F[植物/虫/医療などの専門アプリ]

E -->|いいえ| G[汎用アプリで良い]1行用語集

- 視覚検索: 画像を入力にして対象を識別・検索する技術。

- 画像認識: 画像データから特徴を抽出して分類する処理。

まとめ

視覚検索は現場で素早く答えが欲しい場面に非常に有用です。CamFind と Blippar の簡易比較では CamFind が人物特定や関連リンクの提示で優れた結果を示しましたが、視覚検索全体は誤認識や文脈欠如の問題を抱えているため、単独での完全信頼は禁物です。最適な使い方は、目的に合わせてアプリを選び、結果をテキスト検索や専門家で裏取りすることです。

重要: 視覚検索を導入する際は、精度要件・レスポンス要件・プライバシー方針を明確にして試験することを推奨します。

要点:

- 写真で検索できる利便性は高いが万能ではない。

- CamFind はこの比較では優位、Blippar は一般化傾向が強い。

- 実運用では複数ツールの併用、プライバシー配慮、継続的な評価が必須。